2026 年 4 月 24 日,DeepSeek 发布了 V4 系列模型,引发广泛关注。这次主要发布了两款模型:DeepSeek V4 Pro 和 DeepSeek V4 Flash,均支持 100 万上下文、开放权重,并提供 API 服务。

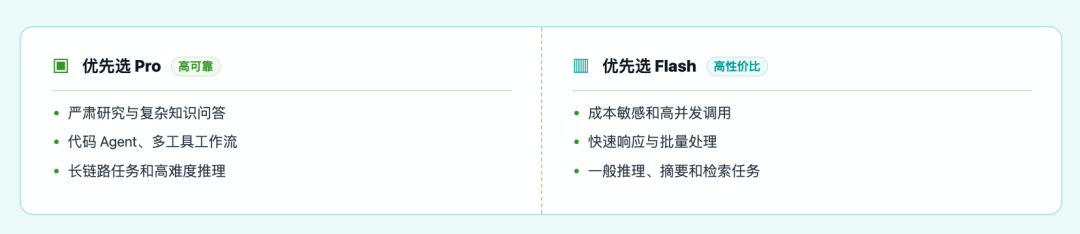

V4 Pro vs V4 Flash:怎么选?

V4 Pro 可以理解成旗舰版,更适合知识任务、复杂推理任务,以及各种 Agent 场景。V4 Flash 则更偏高效率,推理资源和使用成本更友好,如果给足 thinking budget,有些推理表现可以接近 Pro。

但别把 Flash 理解成「便宜版 Pro」。在知识覆盖、复杂任务稳定性上,它和 Pro 还是有差距的。

选择建议:

- 想要能力上限 → 选 V4 Pro

- 想要性价比和速度 → 选 V4 Flash

- 做代码 Agent、长上下文任务、复杂推理 → 先试 V4 Pro

- 做批量处理、轻量任务、成本敏感任务 → 先试 V4 Flash

苏米注:在模型差距不是特别明显的时候,榜单分数最高的模型,不一定就是你任务里最好用的模型。建议把它放到自己的工作流里测,拿一组你平时真的会用的问题跑一轮,比看十个精选 Demo 更有价值。

官方技术报告:huggingface.co/deepseek-ai/DeepSeek-V4-Pro

如何客观评估 V4 的能力?

先别急着看网上那些花哨的 Case。有些案例看起来确实很炫,但不一定能说明模型在真实工作流里的表现。尤其是 Vibe Coding 出几个 Demo 项目,这种东西很容易高估 AI 的水平。

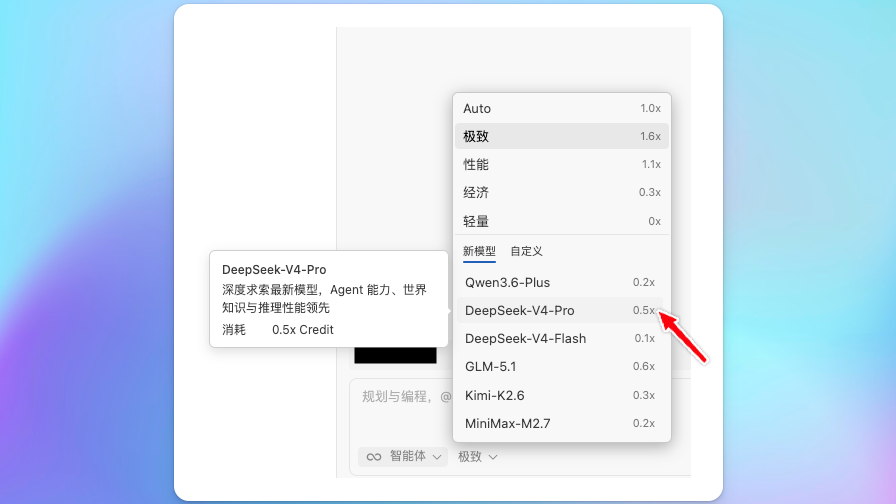

想粗略看 DeepSeek V4 的定位,可以先看 Qoder 里的消费倍率。根据经验,模型能力越强,通常成本越高,倍率也会更高。这个倍率不是严谨评测,但和实际体感比较接近。

当然,模型能力没有唯一标准。主流评测集是一种参考,平台倍率是一种参考,别人的体验也只是一种参考。比如同样是一个模型,用来写代码、做长文分析、跑 Agent 工作流,和用来做摘要、抽取、简单问答,体验可能完全不一样。

DeepSeek 这次发布的克制

这次 DeepSeek V4 发布里,表达比较克制。现在很多模型发布都会把精选 Case 放得很大,甚至故意制造「已经无所不能」的感觉。DeepSeek 这次给我的感觉不太一样,比较客观。

官方原文:「V4-Pro 已达到当前开源模型最佳水平。据评测反馈使用体验优于 Sonnet 4.5,交付质量接近 Opus 4.6 非思考模式,但仍与 Opus 4.6 思考模式存在一定差距。」

最后一句话让人肃然起敬:「不诱于誉,不恐于诽,率道而行,端然正己。」

DeepSeek V4 全面适配国产芯片,100 万上下文进一步成为开源模型的重要标配,同时开放模型权重。这件事本身就已经很有分量了。

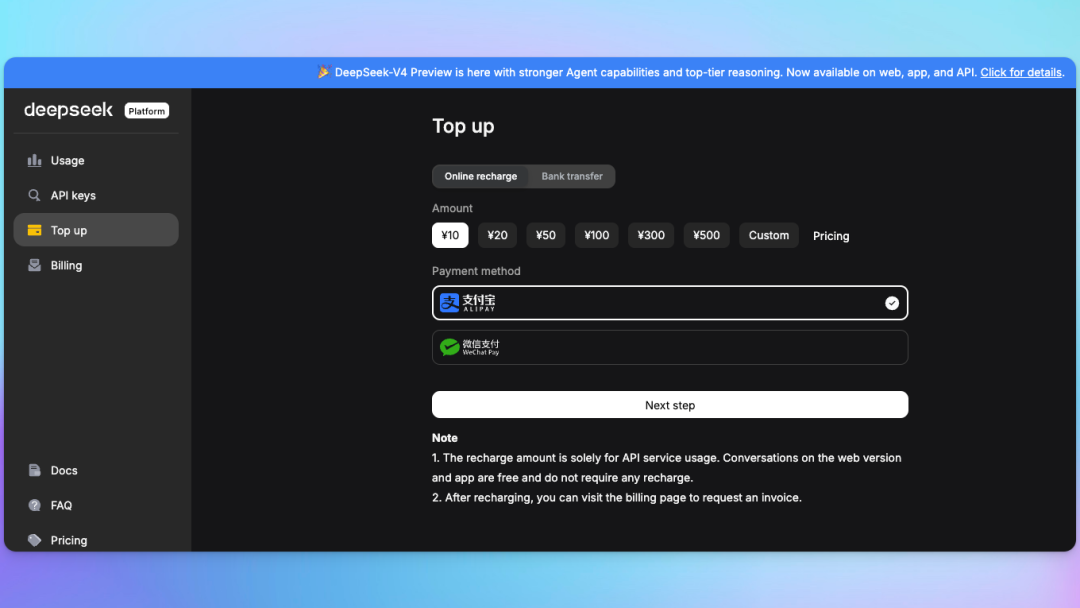

如何接入 DeepSeek V4?

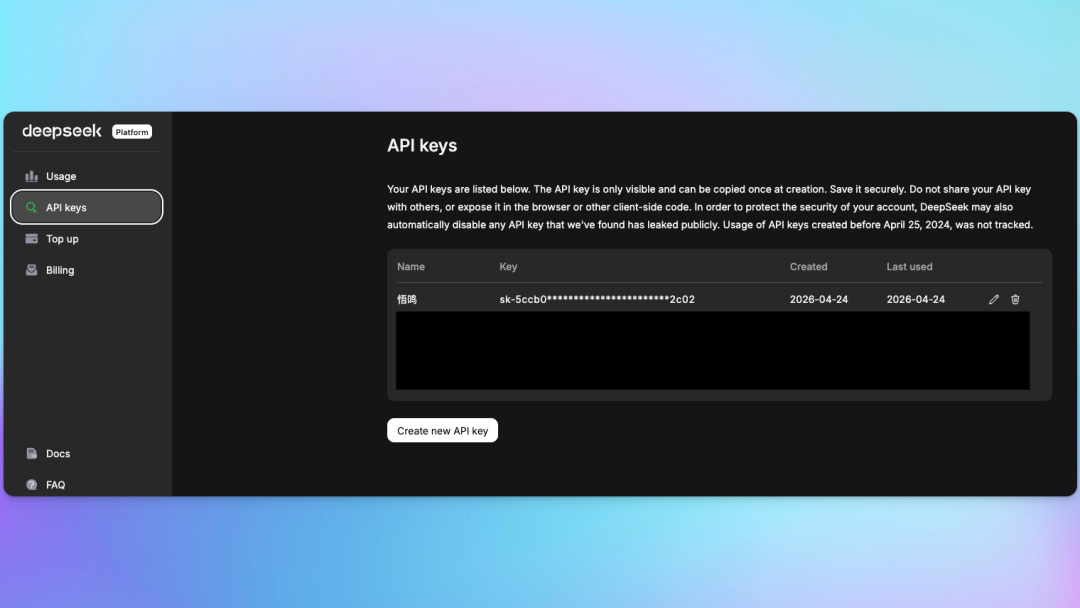

第一步:进入 DeepSeek 平台充值

充值地址:platform.deepseek.com/top_up

第二步:在平台里创建 API Key

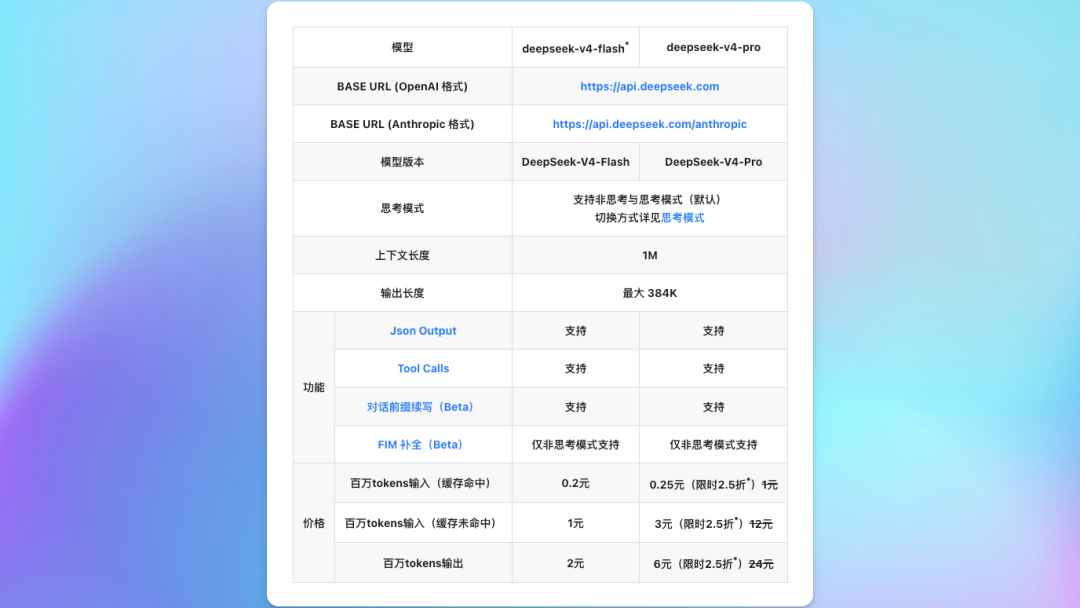

第三步:查看官方价格表

截至 2026 年 4 月 25 日,deepseek-v4-pro 模型还有限时 2.5 折,优惠期到北京时间 2026 年 5 月 5 日 23:59。

常用 API 地址

- OpenAI 协议 URL:

https://api.deepseek.com - Anthropic 协议 URL:

https://api.deepseek.com/anthropic

使用 cc-switch 管理模型服务商

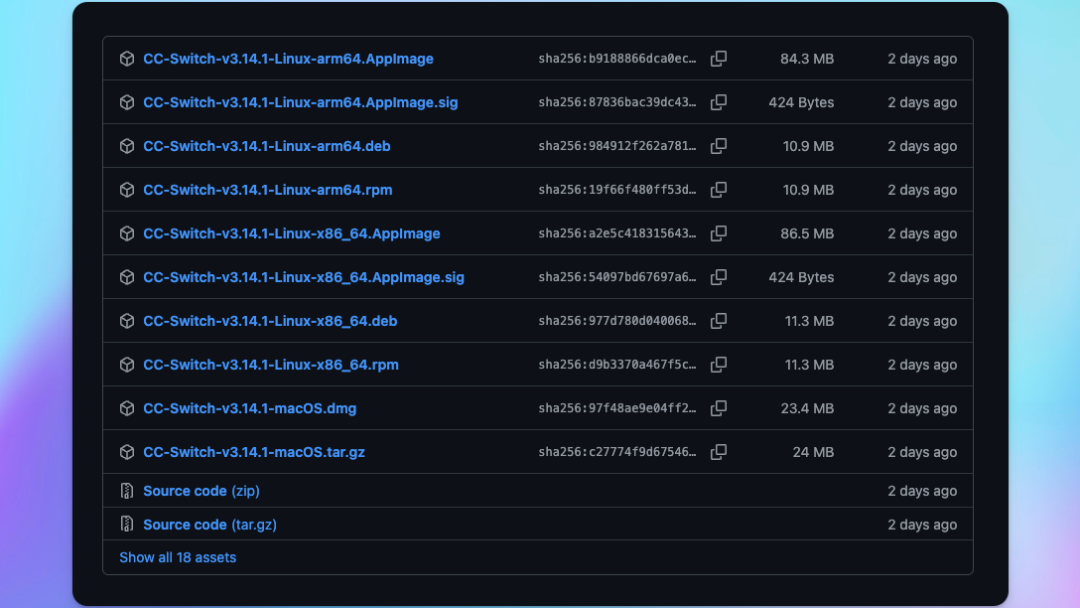

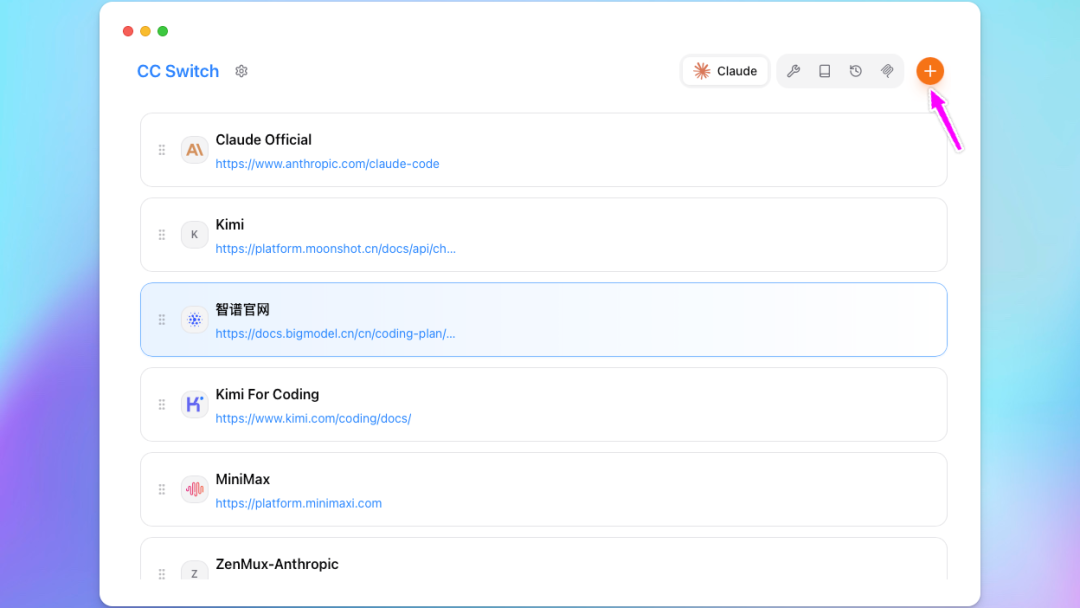

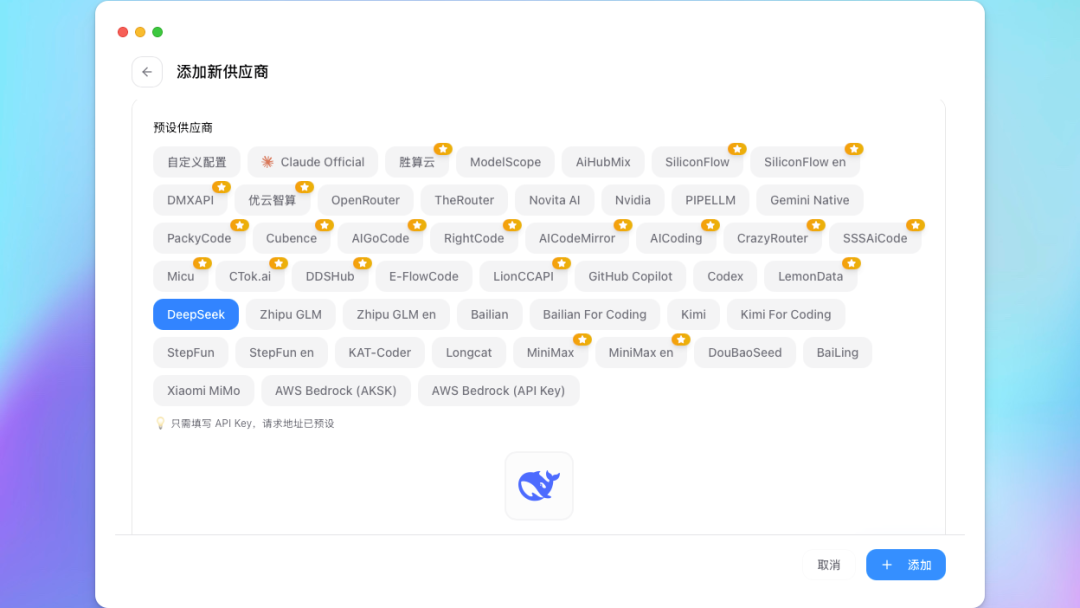

如果平时使用 Claude Code、Codex、Gemini CLI、OpenCode、OpenClaw、Hermes 等工具,推荐用 cc-switch 来管理模型服务商。

下载地址:github.com/farion1231/cc-switch

安装好后,在右上角添加模型服务商,选择 DeepSeek,填入模型名称和 API 信息。回到主界面切换到 DeepSeek,打开 Claude Code 等工具就可以直接使用了。

其他软件也差不多,本质上就是填好 API Key、Base URL 和模型名。

写在最后

DeepSeek V4 让 100 万上下文成标配、开放 Pro 模型权重。至于它在你的工作里是不是最好用,还是那句话:别只看榜单,别只看自媒体大 V 的花哨 Demo。拿你的真实任务测几轮,得出来的结论更靠谱。

对个人用户来说,当前如果没有 Coding Plan,直接购买大模型 API 还是蛮贵的。希望后面模型价格能继续降下来,让 AI 给生活、工作和学习带来更大助力。