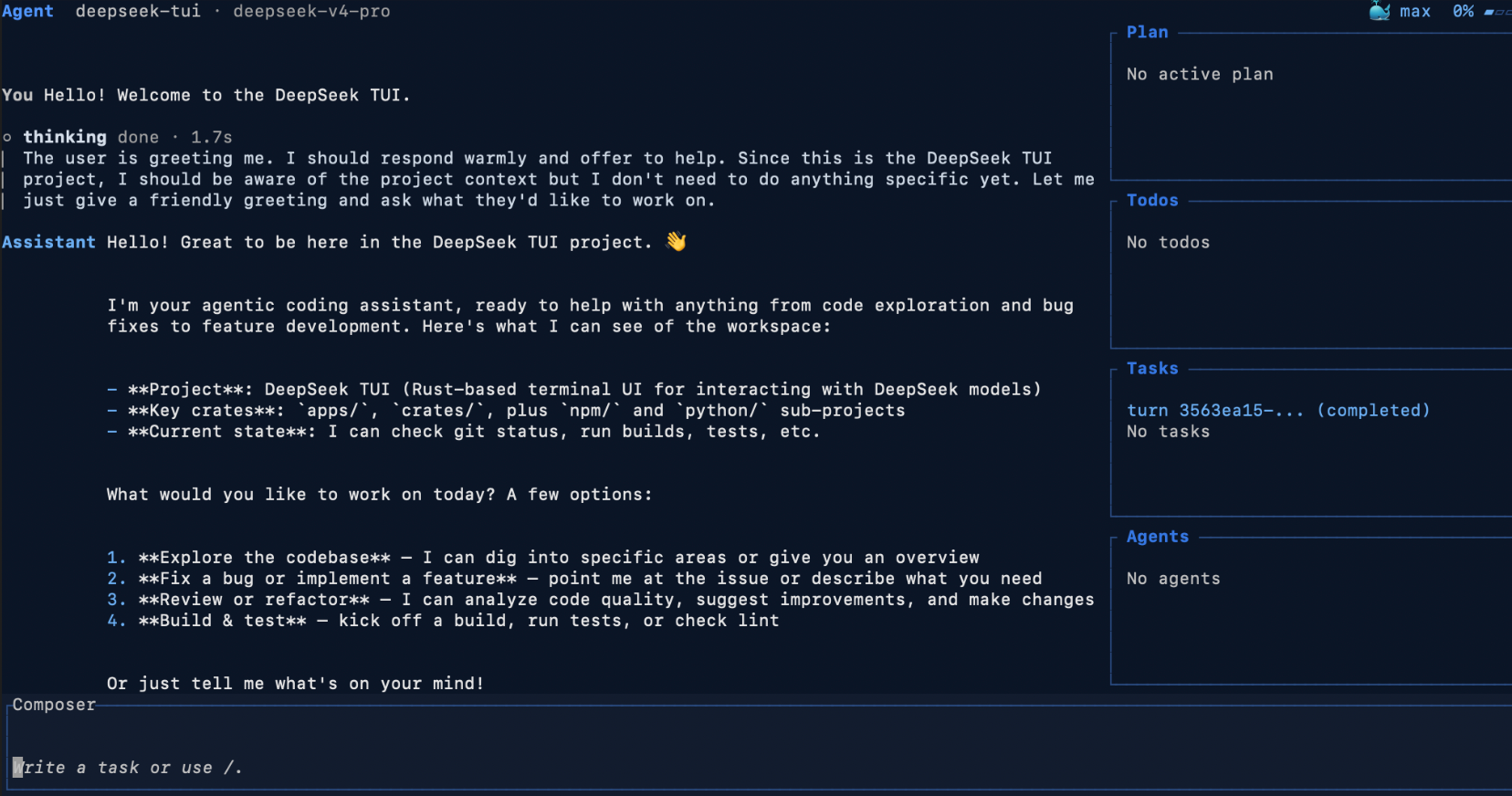

DeepSeek 近日发布了全新的终端编码智能体 DeepSeek TUI,在 GitHub 开源仅 2 天就斩获 3500+ Star。这个项目将 DeepSeek V4 模型直接嵌入终端,为开发者提供了一套完整的编码智能体体验。

与常见的 Web 或 IDE 插件形式的 AI 编码助手不同,DeepSeek TUI 完全扎根于终端环境,支持文件操作、Shell 执行、Git 管理、网页搜索等完整工具链,还能实时展示模型的思考过程。

项目定位:终端原生的编码智能体

DeepSeek TUI 是一个完全在终端中运行的编码智能体,专门为 DeepSeek V4 系列模型(deepseek-v4-pro / deepseek-v4-flash)构建。它通过快速、键盘驱动的 TUI(文本用户界面)提供以下核心能力:

- 读取和编辑工作区文件

- 运行 Shell 命令

- 搜索网页

- 管理 Git 仓库

- 编排子智能体

支持 1M Token 上下文窗口和原生的思考模式(思维链)流式输出——你可以看到模型的推理过程实时展开,就像在看它思考一样。

七大核心特性

1. 原生 RLM 并行推理

内置 RLM(rlm_query 工具)支持,可同时启动 1-16 个 deepseek-v4-flash 子智能体并行工作,适用于批量分析、任务分解或并行推理场景。

2. 思考模式实时展示

最吸引人的特性之一就是思考模式的流式展示。你可以看到 DeepSeek 的思维链(chain-of-thought)在实时展开,看着它如何一步一步推理代码、分析问题、规划解决方案。这种透明性让 AI 的决策过程变得可理解、可追踪。

3. 完整的工具套件

提供文件操作、Shell 执行、Git 管理、网页搜索/浏览、应用补丁、子智能体、MCP 服务器等完整工具链。这些工具不是摆设,而是真正能让 AI 动手去做事的利器。

4. 1M Token 超长上下文

支持 DeepSeek V4 的 1M Token 上下文窗口,当上下文填满时还能自动进行智能压缩。

5. 三种工作模式

提供三种交互模式,满足不同场景的安全与效率需求:

| 模式 | 权限 | 适用场景 |

|---|---|---|

| Plan | 只读探索 | 模型先探索和提出分解计划再进行修改 |

| Agent | 多步工具+审批 | 默认模式,每步操作需人工确认 |

| YOLO | 自动批准所有工具 | 受信任工作区中的全自动化操作 |

6. 会话保存与工作区回滚

支持会话的保存和恢复,可以在长时间运行的任务中进行检查点保存和恢复。更贴心的是,它通过 side-git 在每轮操作前后进行快照,使用 /restore 和 revert_turn 命令就能回滚,而且不会影响你仓库的 .git。

7. 多语言 UI 支持

通过 settings.toml 中的 locale 设置,可以控制界面的显示语言,包括简体中文、日语、葡萄牙语(巴西)等,而不会改变模型输出的语言。

安装指南

DeepSeek TUI 提供了四种安装方式:

方式一:npm 安装(推荐)

npm install -g deepseek-tui

deepseek --version方式二:Cargo 安装(适合 Rust 开发者)

在国内网络环境下,可配置清华镜像加速:

# ~/.cargo/config.toml

[source.crates-io]

replace-with = "tuna"

[source.tuna]

registry = "sparse+https://mirrors.tuna.tsinghua.edu.cn/crates.io-index/"

# 安装

cargo install deepseek-tui-cli --locked # 提供 deepseek 命令

cargo install deepseek-tui --locked # 提供 deepseek-tui 命令(可选)方式三:预编译二进制文件

直接从 GitHub Releases 页面下载对应平台的预编译二进制文件。

方式四:从源码安装

git clone https://github.com/Hmbown/DeepSeek-TUI.git

cd DeepSeek-TUI

cargo install --path crates/tui --locked # 需要 Rust 1.85+配置与使用

API 密钥配置

首次启动时会提示输入 DeepSeek API 密钥。也可以提前设置:

# 通过 CLI

deepseek login --api-key "YOUR_DEEPSEEK_API_KEY"

# 或通过环境变量

export DEEPSEEK_API_KEY="YOUR_DEEPSEEK_API_KEY"常用命令速查

| 命令 | 功能 |

|---|---|

deepseek |

交互式 TUI 启动 |

deepseek "提示词" |

一次性提示,无需交互 |

deepseek --model deepseek-v4-flash |

指定模型 |

deepseek --yolo |

YOLO 模式(自动批准工具) |

deepseek doctor |

检查设置和连接性 |

deepseek sessions |

列出已保存的会话 |

deepseek resume --last |

恢复最新会话 |

deepseek mcp list |

列出已配置的 MCP 服务器 |

多提供商支持

除 DeepSeek 官方 API 外,还支持其他提供商,如英伟达 NIM:

deepseek auth set --provider nvidia-nim --api-key "YOUR_NVIDIA_API_KEY"

deepseek --provider nvidia-nim

# 或按进程设置

DEEPSEEK_PROVIDER=nvidia-nim NVIDIA_API_KEY="***" deepseek苏米注

DeepSeek TUI 的出现标志着 AI 编码助手正在从「辅助工具」向「自主智能体」演进。与 Claude Code、Cursor 等竞品相比,它的最大特色在于:

① 原生终端体验:不依赖任何 IDE,对喜欢终端的开发者极为友好;② 思考过程透明:实时展示思维链,建立对 AI 决策的信任;③ 并行推理能力:RLM 子智能体机制在同类产品中较为独特。

目前项目刚开源 2 天就获得 3500+ Star,活跃度极高,值得持续关注。如果你是一个喜欢在终端里工作的开发者,或者想要一个更原生、更强大的 AI 编码助手,DeepSeek TUI 值得一试。

GitHub:https://github.com/Hmbown/DeepSeek-TUI