用 4 亿 Token 烧出来的 AI 协同工具,解决了一个开发者最痛的痛点:如何让昂贵的 AI 模型只干最复杂的活。

Octrix 是一款创新的多模型协同工具,它允许开发者将不同厂商的 AI 模型(如 GPT-4、Claude Opus 等)组合成一个"团队",根据智能程度分配任务——让昂贵的模型负责核心逻辑,廉价的模型处理编译、提交信息等简单任务。

核心问题:AI 工具利用率低,成本高

开发者在使用 AI 编程工具时,普遍面临三个问题:

- 成本高昂:高端模型(如 Claude Opus)价格昂贵,但常被用来处理简单任务

- 上下文限制:单个 AI 智能体窗口有限,同一件事上下文太大会导致记忆丢失

- 单点依赖:过度依赖单一模型,无法获得多元化视角

Octrix 的解决方案是:让多个 AI 模型分工合作,各司其职。

核心功能:多模型协同的三大突破

1. 智能分工机制

Octrix 允许用户根据任务的复杂度,智能分配给不同层级的 AI 模型:

| 任务类型 | 推荐模型 | 成本/千 Token | 说明 |

|---|---|---|---|

| 核心业务逻辑 | Claude Opus | $15 | 最贵但最智能,处理复杂推理 |

| 代码生成 | GPT-4 | $3 | 性价比高,适合常规编码 |

| 编译/提交信息 | GPT-3.5 | $0.5 | 便宜快速,处理简单任务 |

| 代码 Review | 多模型并行 | 按需 | 多个模型互相审查,提高质量 |

实际效果:通过合理分工,整体 AI 使用成本可降低 60-80%。

2. 跨厂商模型协作

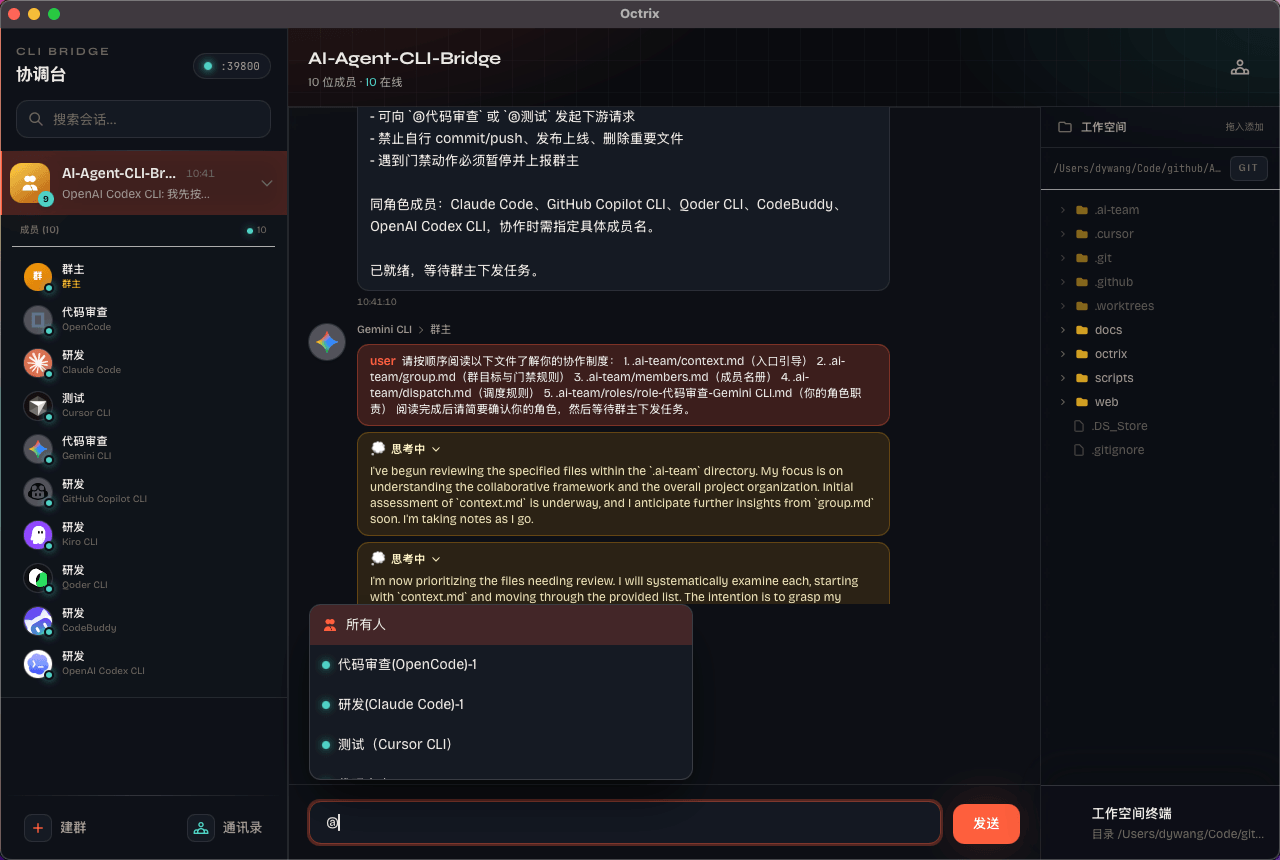

Octrix 支持将不同厂商的 AI 模型拉入同一个"群聊",模拟多人团队进行协作:

- 需求讨论:拉 2 个"AI 产品经理"进群,从不同角度分析需求

- 技术方案:拉 N 个"AI 工程师"提供多种技术实现方案

- 代码 Review:多个"AI 审查员"互相 review 代码,发现潜在问题

核心洞察:不同厂商的模型有不同的训练数据和偏好,多元视角能产生更优方案。

3. 分工机制规避上下文限制

单个 AI 智能体的上下文窗口有限,当同一件事的上下文太大时,会导致记忆丢失而"变笨"。

Octrix 的分工机制可以将大任务拆解为多个小任务,分配给不同的 AI 智能体,每个智能体只需关注自己的子任务,从而:

- 减少单个 AI 的上下文 Token 数量

- 避免长上下文导致的记忆丢失

- 保持每个 AI 智能体的专注度和准确性

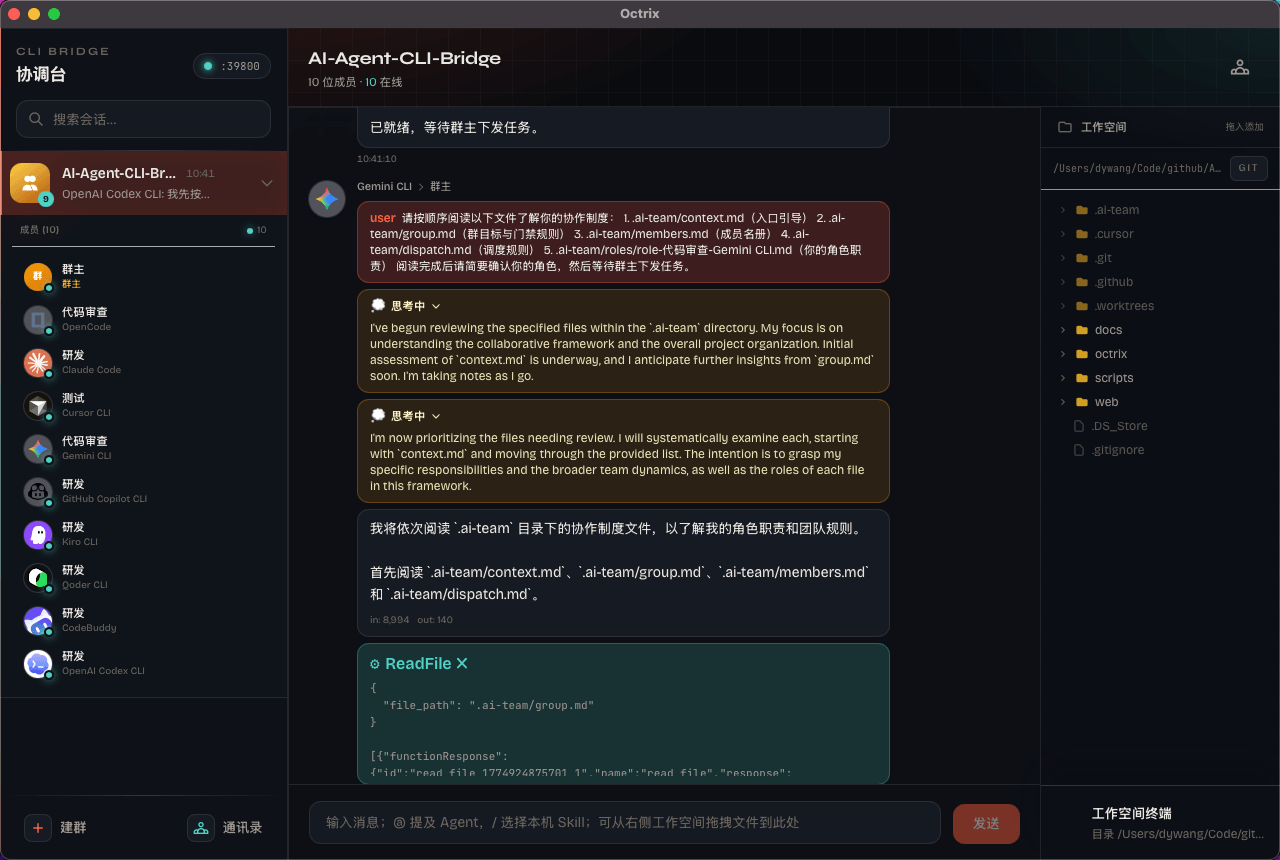

功能亮点:AI 进群协作

Octrix 把多个 AI 能力带进同一个工作空间,让每个成员都能像在群聊里协作一样,快速推进任务。

AI 进群协作

把多个 AI Agent 放进同一个协作场景,多角色并行参与,减少单线程问答的来回切换。

多人实时共创

团队成员与 AI 在同一上下文中协作,信息同步更快,讨论与执行衔接更顺畅。

任务推进更高效

从需求讨论到方案细化再到执行落地,AI 可以持续接力,提升整体交付效率。

对话即工作流

用自然语言驱动协作流程,把沟通过程直接转化为可执行产出。

聚焦结果导向

围绕"把事情做成"设计协作体验,减少信息散落和重复沟通。

使用场景

| 场景 | 传统方式 | Octrix 方式 | 效率提升 |

|---|---|---|---|

| 需求分析 | 1 个 AI 反复问答 | 2-3 个 AI 并行讨论 | 3 倍 |

| 技术方案 | 单一方案 | 多方案对比 | 2 倍 |

| 代码 Review | 人工或单 AI | 多 AI 交叉审查 | 5 倍 |

| 成本优化 | 统一用高端模型 | 按任务分级分配 | 60-80% |

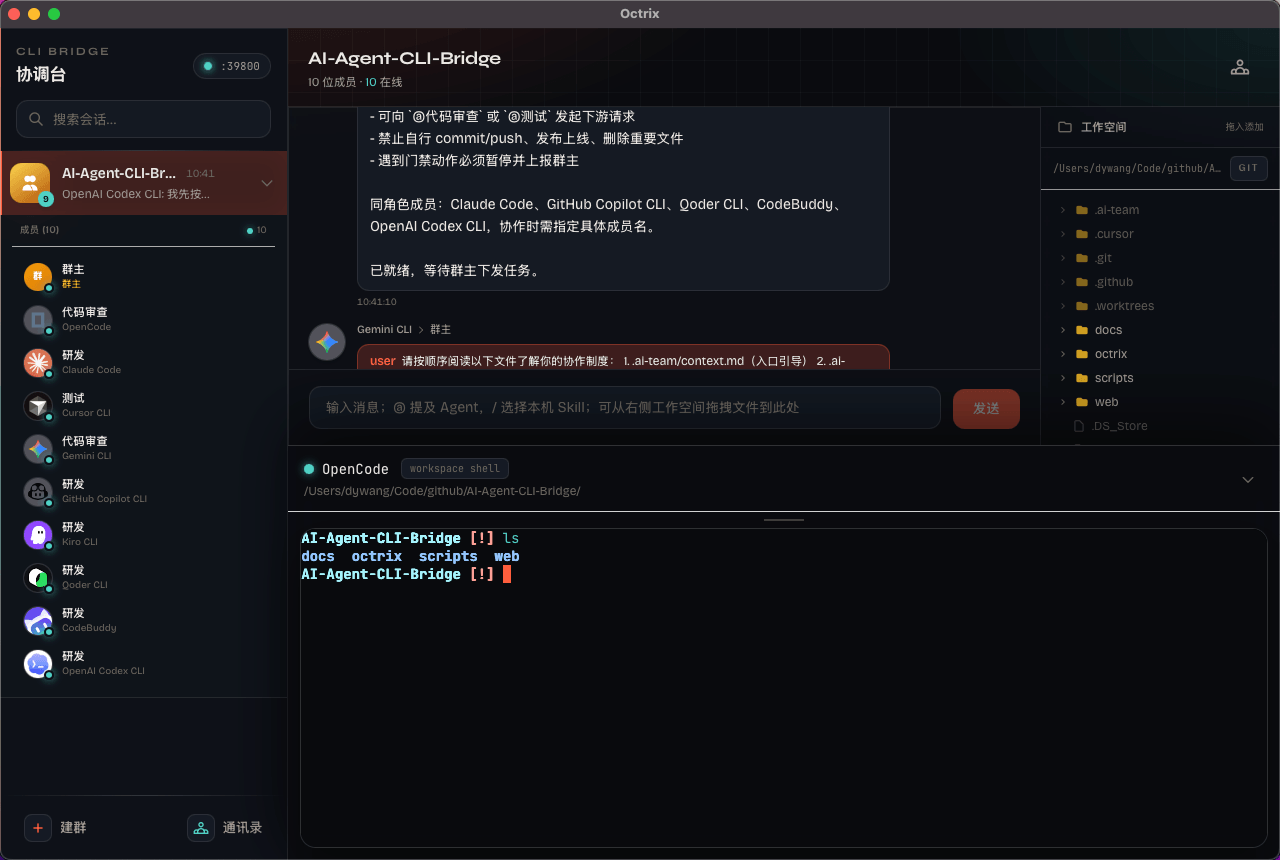

技术架构

Octrix 的核心架构包含三个层次:

- 模型接入层:支持 OpenAI、Anthropic、Google 等多厂商 API 接入

- 任务调度层:智能分析任务复杂度,自动分配给合适的模型

- 协作管理层:维护多 AI 对话上下文,确保信息同步和任务衔接

总结

Octrix 代表了一种新的 AI 使用范式:从单一模型到多模型协同,从全权委托到智能分工。

核心价值:让最贵最智能的 AI 干最复杂的活儿,让便宜的不是那么聪明的 AI 干简单的活儿,实现算力资源的最佳配置。

对于高频使用 AI 编程的开发者来说,这是一个值得尝试的工具——既能降低成本,又能提高代码质量。

相关资源

Octrix 官网:https://octrix.work/