苏米注:Gemini 3.1 Flash TTS 发布后,我花了 3 小时深度测试,发现了 3 个官方没说清楚的坑和 2 个实用神技。今天这篇文章帮你避开这些坑,同时充分利用它的强大功能。

一、坑①:中文发音偶尔翻车,专业术语直接"翻译腔"

第一个坑,也是最容易翻车的:中文发音稳定性不如英语。

Gemini 3.1 Flash TTS 支持 70+ 种语言,中文普通话在列,而且模型能自动识别输入文本的语种,无需开发者手动标注。但实际用起来,普通对话没问题,一旦遇到专业术语、生僻词、多音字,翻车概率明显上升。

实测案例:

- 读"本项目采用微服务架构,通过 API 网关进行统一路由",读到"API 网关"时,突然切换成"标准播音腔",把"网关"读得一字一顿

- "容器编排"读成"容器——编排",中间莫名其妙顿了一下

- "分布式事务"读对了,但语调突然拔高,跟前面的沉稳旁白完全不在一个频道

- "DAU"直接读成"大——唔","LTV"读成"了——TV"

苏米注:为什么会这样?Gemini TTS 的训练数据以通用语料为主,专业术语、行业黑话的训练量不足。英语里的缩略词(如 API、KPI、SLA)它读得溜,因为训练数据多。换成中文缩略词或专业术语,它就开始"猜"。

解决方案:

- 专业术语加拼音注释:比如"API(A-P-I)网关",虽然麻烦,但效果立竿见影

- 拆词替换:把"DAU"换成"日活跃用户数",把"LTV"换成"用户生命周期价值"

- 重要内容人工复核:如果音频要对外发布,建议人工听一遍,尤其是专业术语部分

二、坑②:成本没算清楚,钱包可能被"偷"

第二个坑,是成本。不是贵,是很多人没算明白。

官方定价:

- 文本输入:每百万 Token 1 美元

- 音频输出:每百万 Token 20 美元

- 批量模式价格减半

成本测算:

- 3 分钟播客脚本,约 450 个汉字(约 600-700 Token)

- 输入成本:600 Token × $1/百万 ≈ $0.0006(忽略不计)

- 输出成本:输出 Token 数 = 音频时长(秒)× 24,3 分钟(180 秒)约 4320 Token,4320 × $20/百万 ≈ $0.0864

苏米注:3 分钟音频不到 9 美分,看起来确实不贵。但如果你有 100 集播客(每集 30 分钟),成本就不是小数目了:每集约$0.864,100 集约$86.4(批量模式约$43.2)。

更隐蔽的是"测试成本":很多人反复生成、反复调试提示词,每一个测试版本都在烧钱。调试 10 个版本,成本翻 10 倍,钱花在"试错"上,而不是"产出"上。

省钱技巧:

- 先用免费层测试:免费层有额度,用来调试提示词、找感觉,等调满意了再切付费

- 批量模式:如果音频量较大,强烈建议用批量模式,价格直接腰斩

- 控制单次生成长度:官方限制单次生成音频时长上限约 11 分钟,如果想生成更长的内容,需要拆分成多个短片段

- 缓存机制:Google 提供缓存计费模式(缓存输入每百万 Token $0.50,缓存输出每百万 Token $10.00),如果频繁调用相同或相似的输入文本,用缓存能省下一半的成本

三、坑③:长文本处理有"隐形天花板"

第三个坑,是长文本处理的稳定性问题。

官方限制单次生成音频时长上限约 11 分钟,超过需拆分。但即便在限制以内,测试一段约 8000 字符的播客脚本,生成过程中出现了一次"意外中断"——音频在 3 分钟处戛然而止,没有任何错误提示。

更麻烦的是长对话的"角色串线"。在一个 20 分钟的播客脚本里,设置了两个角色,Gemini 能正常生成,但到了后半段,两个角色的声线偶尔会"串线"——甲方突然用了乙方的声音,乙方又变得像甲方。

解决方案:

- 主动拆分:把长文档按章节或逻辑段落拆成多个短片段,分别生成后再拼接。用音频编辑软件(如 Audacity)无缝拼接即可

- 分段生成后统一风格:确保每个片段的语音风格、角色设定保持一致,避免拼接后听起来割裂

- 测试阈值:建议先小批量测试,摸清自己账号的稳定输出上限

四、神技①:用 Audio Tags"导演"声音

Gemini 3.1 Flash TTS 最强大的能力,是 Audio Tags(音频标签)。你可以在文本中直接嵌入自然语言指令,精确控制语音风格、语速和表达方式。

实测案例:广播剧脚本

[scene:深夜便利店,安静,略带悬疑]

[voice:收银员,疲惫,慢吞吞]

"欢迎光临……"

[doorbell rings,急促脚步声]

[voice:顾客,紧张,压低声音]

"有没有……有没有创可贴?"

[voice:收银员,被吓到,声音发抖]

"在……在第二排货架上。"10 秒后,音频出来了。收银员的拖腔、顾客的颤抖、收银员被吓到后的磕巴,全"演"出来了。

苏米注:Google 官方称支持 200 多种音频标签,控制情绪、节奏、重音等维度。而且没有标签数量限制,你可以发挥创意。

常用标签:[whispers]、[excitedly]、[sarcastically]、[laughs]、[cough]、[sighs]、[gasp]

进阶技巧:多角色对话时,你可以给每个角色分配独立的"音频档案"——分别设定语速、语气、甚至口音,确保声线不串场。这项功能叫"说话人级别的精细控制",是本次发布的核心能力之一。

五、神技②:场景方向(Scene Direction),让 AI"入戏"

如果说 Audio Tags 是"逐句控制",那场景方向(Scene Direction)就是"全局定调"。

你可以在生成前给整段录音设定一个环境背景和情绪基调。比如加上"深夜、便利店、安静、略带悬疑",AI 在多轮对话里都会保持"入戏"状态,不会说着说着就跑偏。

实测对比:生成两段对话,第一段加了场景方向"紧张、急促",第二段不加任何场景描述。第一段的语速明显更快、停顿更少、情绪更紧绷,第二段就是标准的"播音腔"。

苏米注:这项能力对有声读物、播客、游戏配音等场景特别实用。你想让它读出"悬疑感",不用堆砌形容词,告诉它"场景:废弃医院,深夜,风声,主角独自一人",AI 自己就会调整语气。

六、总结与建议

玩 AI 工具,不能只看"上限",也要摸清"下限"。

Gemini 3.1 Flash TTS 的"上限"很高:Audio Tags、场景方向、多说话人控制,让 AI 配音从一个"工具"进化成了"演员"。

但"下限"也需要你自己兜住:中文专业术语发音不稳、长文本可能"串线"、成本要精打细算……这些官方文档不会主动告诉你的"坑",只能靠实测来填。

最佳实践:

- 先用免费层小批量测试,摸清模型的脾气

- 测试发音稳定性、长文本输出上限、声线会不会"串"

- 等测试满意了,再用付费层大规模生产

- 批量模式能省一半成本,适合规模化生产

- 长文本主动拆分,避免意外中断

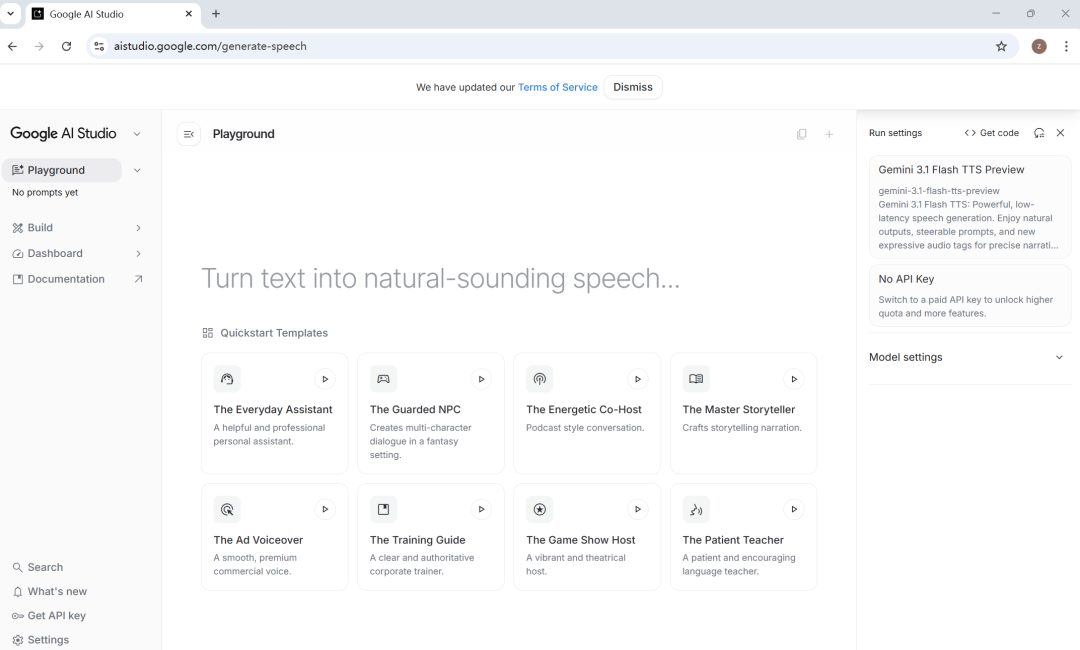

项目地址:Google AI Studio