你是不是也遇到过这种情况?兴冲冲地打开 Claude Code,准备让 AI 帮你重构代码。结果跑了几个测试、看了几次 git log,额度就见底了。

月底一看账单,单月消耗 80.5B tokens,花了 $41,952。你记得就日志看的多了,正事没干几个,怎么就没有了呢?这钱花得冤不冤?

苏米注:实际上,主要是大部分 token 都喂给了「垃圾信息」。一个 cargo test 输出 155 行,AI 真正需要的可能就 3 行。剩下的?全是噪音。

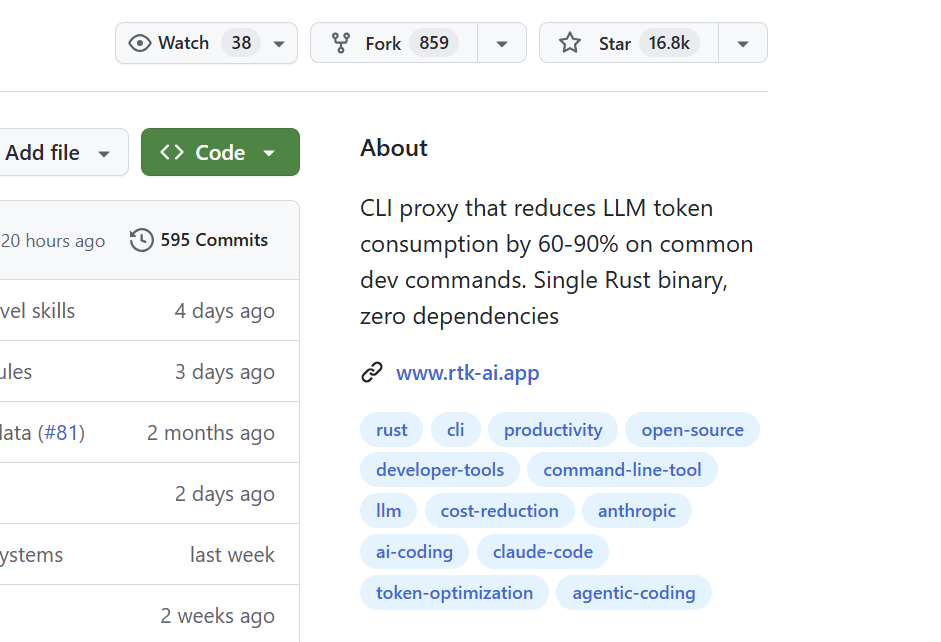

RTK 项目介绍

这个项目叫 RTK,开源一年多,现在已经接近 16.8K Star 了。

它是一个 CLI 代理工具,坐在你的命令行和 AI 之间。命令的输出在塞进上下文之前,它会先自己过滤一遍。一大堆废话直接砍掉,基本能去掉 60-90% 的垃圾,让上下文干净多了。

归根结底,就是让 AI 少看一堆垃圾,多看真正有用的东西。

RTK 如何省 Token?

1. 自动砍噪音

注释、空白行、各种样板代码,这些对 AI 其实没啥帮助,RTK 会自动识别并删掉,只留核心逻辑。

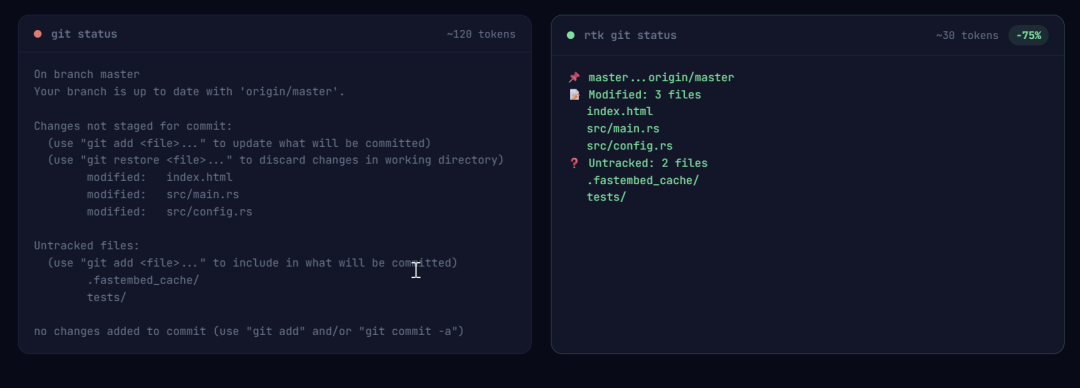

举例:一个 git status 输出原来 119 个字符,过滤后只剩 28 个,压缩了 76%,但该有的信息一个都没少。

2. 相似内容合并

测试跑了 50 个用例,失败了 10 个,以前 AI 会傻傻看到 10 条几乎一模一样的错误日志。现在 RTK 会按目录或错误类型自动聚合,AI 只用看一条摘要就够了。

对那些动不动跑几百个测试的项目来说,这点改动真的很实用。

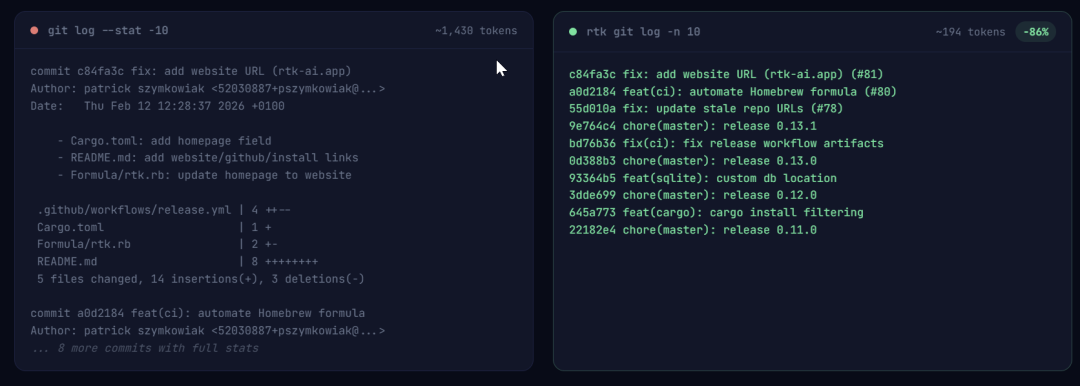

3. 智能截断

git log 输出几百行提交记录?RTK 会聪明地只保留最近的几条和关键节点。既减少了废话,又不会让 AI 突然失去上下文。

4. 重复日志合并

Docker 日志里同一条错误刷了 100 次?RTK 会直接合并成一条,后面加个 (x100)。简单直接,但用起来真舒服。

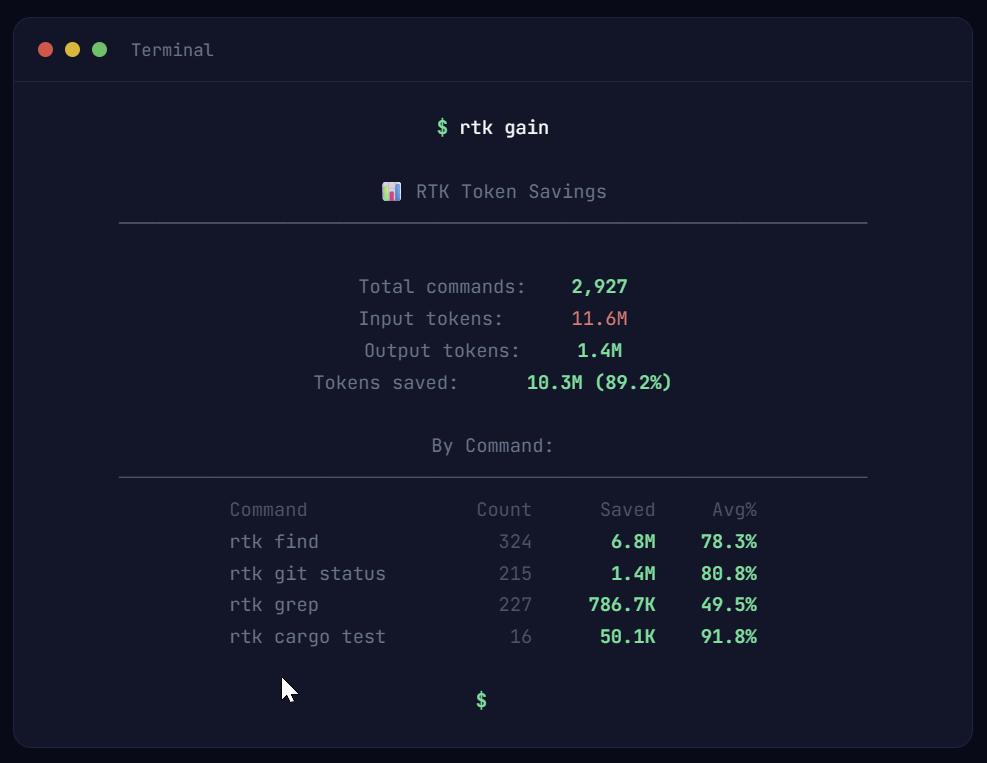

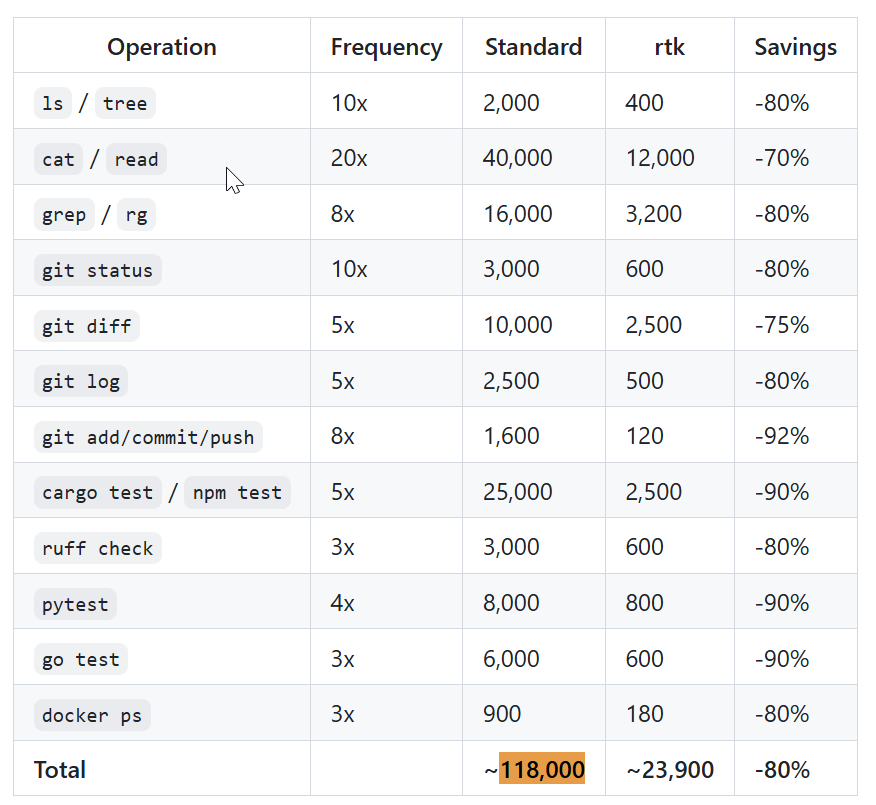

能省多少?

一个 30 分钟的 Claude Code 会话,原本消耗 118,000 tokens。用了 RTK 之后,只用了 23,900 tokens。节省了 80%,属实太猛了。

| 命令类型 | 运行次数 | 原始 Tokens | 过滤后 Tokens | 节省比例 |

|---|---|---|---|---|

| ls / tree | 10 次 | 2,000 | 400 | 80% |

| cat / read | 20 次 | 40,000 | 12,000 | 70% |

| cargo test | 5 次 | 25,000 | 2,500 | 90% |

| git add/commit/push | 8 次 | 1,600 | 120 | 92.5% |

最夸张的是 git add/commit/push,8 次操作直接从 1,600 tokens 干到 120 tokens,压缩效果简直"毫无人性"。

安装教程

macOS 安装

brew install rtkLinux 安装(推荐)

curl -fsSL https://raw.githubusercontent.com/rtk-ai/rtk/refs/heads/master/install.sh | sh配置全局 Hook

装完别忘了配置全局 hook(让 Claude Code 自动使用):

rtk init --global重启 Claude Code 就好了。

常用命令

# 查看能省多少 token

rtk gain

# 发现更多节省机会

rtk discover

# 「只看签名」模式(隐藏函数实现,只保留签名)

rtk read file.rs -l aggressive苏米注:「只看签名」模式对大型代码库特别好,可以快速浏览代码结构而不被实现细节淹没。

支持的 AI 工具

目前支持 10 个主流 AI 编码工具:

Claude Code | GitHub Copilot | Cursor | Gemini CLI | Codex | Windsurf | Cline/Roo Code | OpenCode | OpenClaw

基本上你能想到的,它都支持。

与其他工具叠加使用

Reddit 上有人分享了一个「token 优化栈」:

- RTK:压缩命令输出

- Headroom:压缩 API 流量

- MemStack:防止重复读取

三个工具作用在不同层面,可以叠加使用。这波属于是把 token 优化玩明白了。

总结

RTK 是一个值得尝试的工具,特别是如果你也在用 AI 编码工具,觉得 token 消耗太快。

核心优势:

- 单一 Rust 二进制文件,零依赖

- 性能开销小于 10ms

- 不改你的任何习惯,装上就能用

- 平均节省 60-90% 的 token