Gemini 2.5 Flash-Lite。

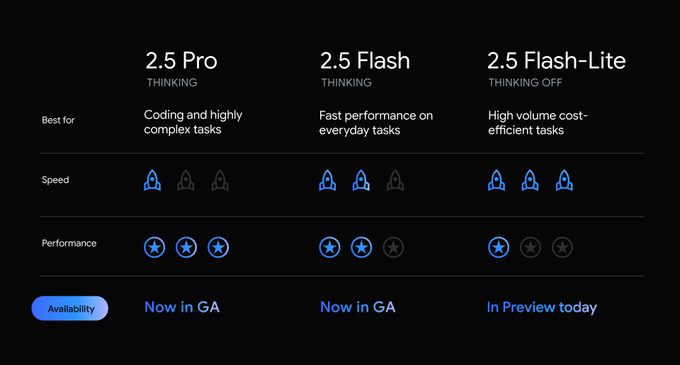

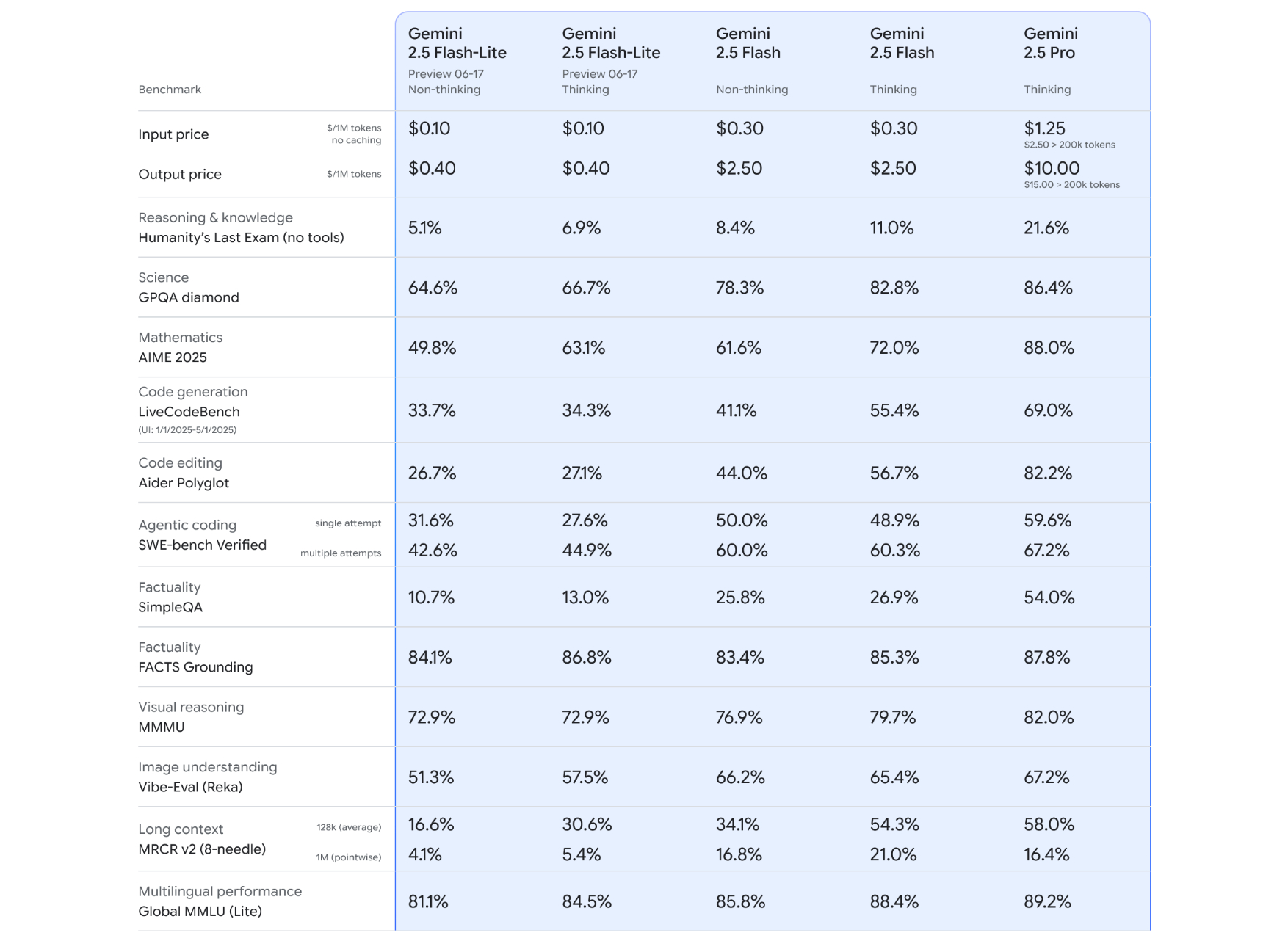

这波更新,可以说是谷歌在 AI 模型领域的一次全面布局:从旗舰级的 Pro,到高性价比的 Flash,再到极致便宜的 Flash-Lite,全覆盖不同需求场景。而这几款模型的定位和能力,也非常值得独立开发者和 AI 产品从业者重点关注。

Gemini 2.5 Pro

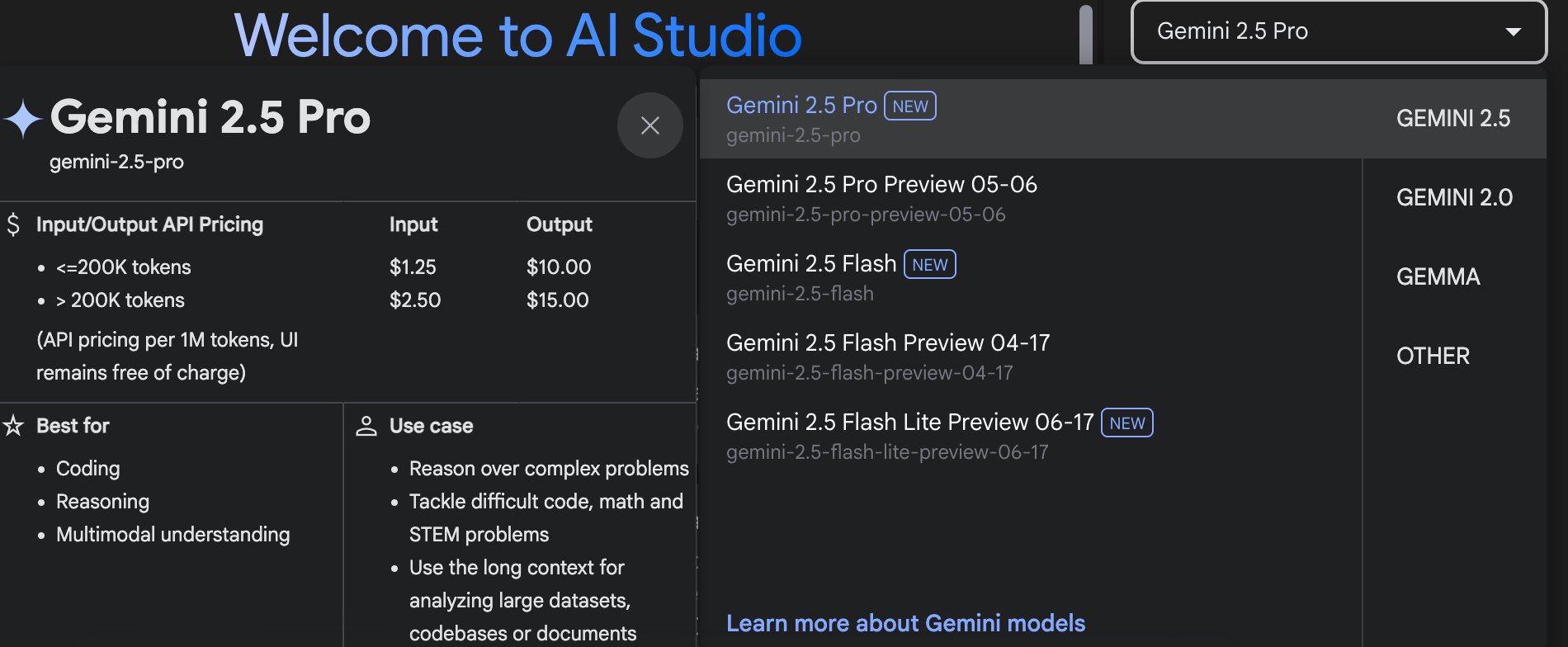

Gemini 2.5 Pro 是我之前在 AI Studio 上用得最多的模型。它一直以“多模态 + 强推理 + 大窗口”的全能选手形象存在,这次 06-05 版本正式成为 GA(General Availability)版本,意味着它终于从“试验品”进化为“可以放心上生产环境”的正式工具。

几个关键能力必须说下:

-

超大上下文窗口:支持 100 万 tokens,可以喂进小说、长论文、甚至是项目文档合集都没问题;

-

多模态处理:图像、音频、视频都能理解,并且具备较强的内容生成能力;

-

深度推理(Deep Think):可以按需开启深思模式,适合复杂逻辑和代码任务;

-

工具调用支持:结构化输出、调用函数、执行代码、实时搜索一个都不少。

价格方面,在 AI Studio 上个人用户免费使用,API 价格相对友好:每百万输入 tokens 1.25 美元,输出 10 美元——不算便宜,但考虑到模型性能,我个人觉得性价比还是很高的。

Gemini 2.5 Flash

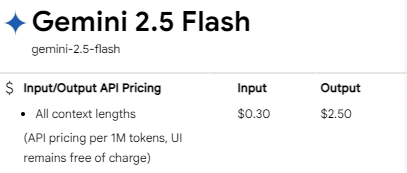

如果你的场景偏向实时响应、高并发,比如客服对话、摘要生成、问答系统,那 Gemini 2.5 Flash 更合适。

这次正式上线的是 05-20 稳定版本,同时更新了价格策略:

-

不再区分“推理”和“非推理”模式

-

每百万输入 tokens 只需 0.3 美元

Flash 模型本身就是为“量大事多”的场景而生,所以功能覆盖面不是最广,但胜在便宜和稳定,而且推理能力保留得也不差。

Gemini 2.5 Flash-Lite

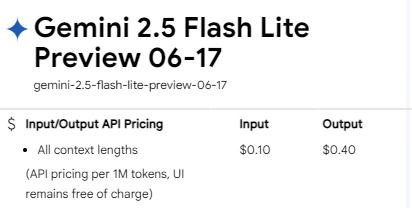

这次更新里我最感兴趣的是新模型 Flash-Lite。目前还只是 preview 版,但已经开放测试。

它就是 Flash 的“瘦身版”,更小、更快、更便宜:

-

输入 0.10 美元 / 百万 tokens

-

输出 0.40 美元 / 百万 tokens

-

默认关闭推理模式,但可以按需开启

-

支持 Google 搜索、Function Calling、代码执行等功能

-

上下文窗口依然高达 100 万 tokens

适合批量处理型的应用场景,比如:内容分类、翻译、摘要、消息提取等。我自己最近就打算用它来做个批量知识卡片生成工具,省钱又高效。

怎么选?

| 模型 | 特点 | 推荐使用场景 |

|---|---|---|

| Gemini 2.5 Pro | 全能旗舰、强推理、多模态 | 编码、Agent、复杂内容生成 |

| Gemini 2.5 Flash | 快速反馈、高吞吐量、便宜 | 客服、摘要、实时问答系统 |

| Gemini 2.5 Flash-Lite | 极致低价、适配高频场景 | 批量文本处理、低智商但高频场景,如翻译、分类 |

对个人用户来说,其实不用犹豫,直接去 AI Studio 免费用 Gemini 2.5 Pro 就好,大部分任务都能 Hold 住。如果你是做工具类应用,Flash-Lite 绝对值得尝试。

总结

OpenAI 刚刚把 o3 模型 API 降了 80%,谷歌这边立马更新 Gemini Flash-Lite 来继续“卷”性价比。

我的直观感受是:AI 模型的竞争已经不再是单纯地卷“智商”,而是越来越往“够用就好”的方向发展。模型要便宜、稳定、能跑得起,而不是光好看榜单分数。

Gemini 系列这次的调整,很明显是奔着“产品效率化”来的,也更加贴近实际落地应用。尤其是 Flash-Lite,我觉得很可能会成为下一个被大量集成在工具里的“隐形主力”。

目前这些模型在 Google AI Studio 和 Gemini 网页版中都可以直接使用,未来还计划支持 200 万 tokens 的上下文,那时候传统的 RAG 都可能不再必要了。

如果你和我一样在做工具产品、内容生成、AI 接入类的功能开发,建议尽早上手新版本 Gemini,感受下它这次“转正+扩军”的真正威力。