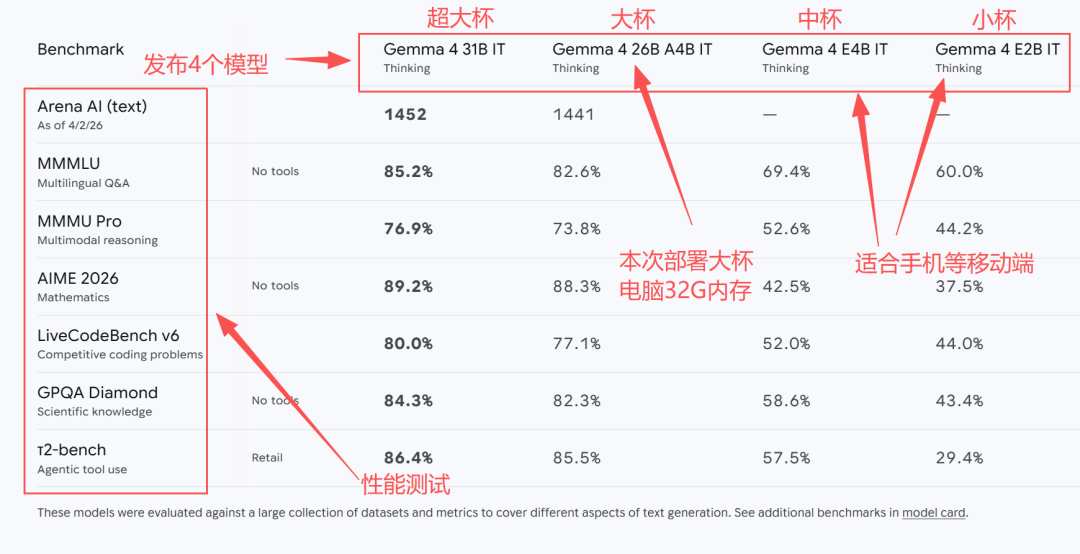

Gemma 4 模型家族与端侧部署场景

Gemma 4 的开源将端侧 AI 推向工程化落地阶段。它提供四个变体,针对不同资源场景设计:E2B(最轻量)、E4B(平衡版)、26B A4B(MoE 架构)和 31B(最强性能)。

端侧部署的核心价值在于本地运行、零延迟、隐私可控。本文从硬件选型、框架选择到部署步骤,提供完整的小白入门指南。

零基础必懂:5 个核心概念

在开始部署前,先理解以下关键概念:

- 端侧部署:将 AI 模型安装到本地设备运行,无需联网,类似"本地玩游戏"vs"去网吧"

- 量化(4-bit/Q4_0):模型压缩技术,将 4K 高清"压缩"为 720P 标清,体积缩小 3-4 倍,速度提升 2-3 倍,肉眼几乎无差别

- KV Cache:模型对话时的临时记忆缓存,上下文越长占用越大,建议预留 1-2GB 缓冲

- NPU(神经处理单元):手机/设备中的 AI 专用加速芯片,类似 CPU 负责计算、GPU 负责图形,NPU 专为 AI 优化

- tokens/s:模型生成速度指标,10+ tokens/s 可满足日常对话,30+ tokens/s 达到流畅聊天体验

内存需求与设备选型

官方内存需求(4-bit 量化起步):

| 模型 | 模型体积 | 最低内存建议 | 适用场景 |

|---|---|---|---|

| E2B | 3.2 GB | 6 GB+ | 2021 年后安卓手机(新手首选) |

| E4B | 5.0 GB | 8 GB+ | 中高端手机(小米 15、华为 Mate70 等) |

| 26B A4B | 15.6 GB | 24 GB+ | 笔记本/工作站(不推荐手机) |

| 31B | 17.4 GB | 32 GB+ | 高配笔记本/服务器 |

苏米注:实际部署时,建议按"模型体积 × 1.3~1.5"预留总内存,防止运行卡顿。例如 E2B 需要 3.2×1.5≈5GB,因此 6GB 内存设备较为稳妥。

设备选型与框架推荐

1. 智能手机(新手推荐)

最低要求:4GB 内存 + NPU 支持

推荐框架:Google LiteRT-LM(Google AI Edge 生态,支持 Android/iOS)

主流手机兼容性参考:

- 华为 Mate70 / Pura 系列(麒麟 NPU):HarmonyOS 优化良好

- 小米 15 / Redmi K80(骁龙 NPU):HyperOS 适配完善

- OPPO Find X8 / Vivo X200(天玑 NPU):ColorOS 集成 AI 功能

- 荣耀 Magic 系列:类似配置

小白提示:可先安装 Google AI Edge Gallery App 免费测试,内置模型下载和运行功能,零代码门槛。

2. 嵌入式开发板(IoT 爱好者)

推荐设备:

- Raspberry Pi 5(8GB 版):官方示例支持 E2B 稳定运行

- RK3588 / RK3576 系列(香橙派 Orange Pi 5、Radxa Rock 5B):NPU 6 TOPS,8GB 内存版本性价比高

框架选择:RKLLM Toolkit(一键转换模型),或 llama.cpp(通用方案)

最低配置:4GB 内存 + ARM64 处理器

3. 笔记本 / 工作站(开发测试)

E2B/E4B:8GB 统一内存即可(苹果 M 系列最优,内存共享)

国内常见 AI 笔记本:华为 MateBook 系列(麒麟/英特尔 NPU)、联想 Yoga(AMD Ryzen AI)

推荐工具:Ollama(一键安装,类似应用商店)

手把手部署步骤

方案一:手机端(Google AI Edge Gallery,3 分钟)

- 打开应用商店,搜索并安装

Google AI Edge Gallery(Android/iOS 均有) - 打开 App → 点击

Models→ 搜索gemma-4-E2B→ 下载 4-bit 版本(约 3.2GB,建议 WiFi 环境) - 下载完成后点击

Chat→ 输入问题即可开始对话(全程离线,NPU 自动加速) - 如需切换模型,重复第 2 步选择 E4B 或其他版本

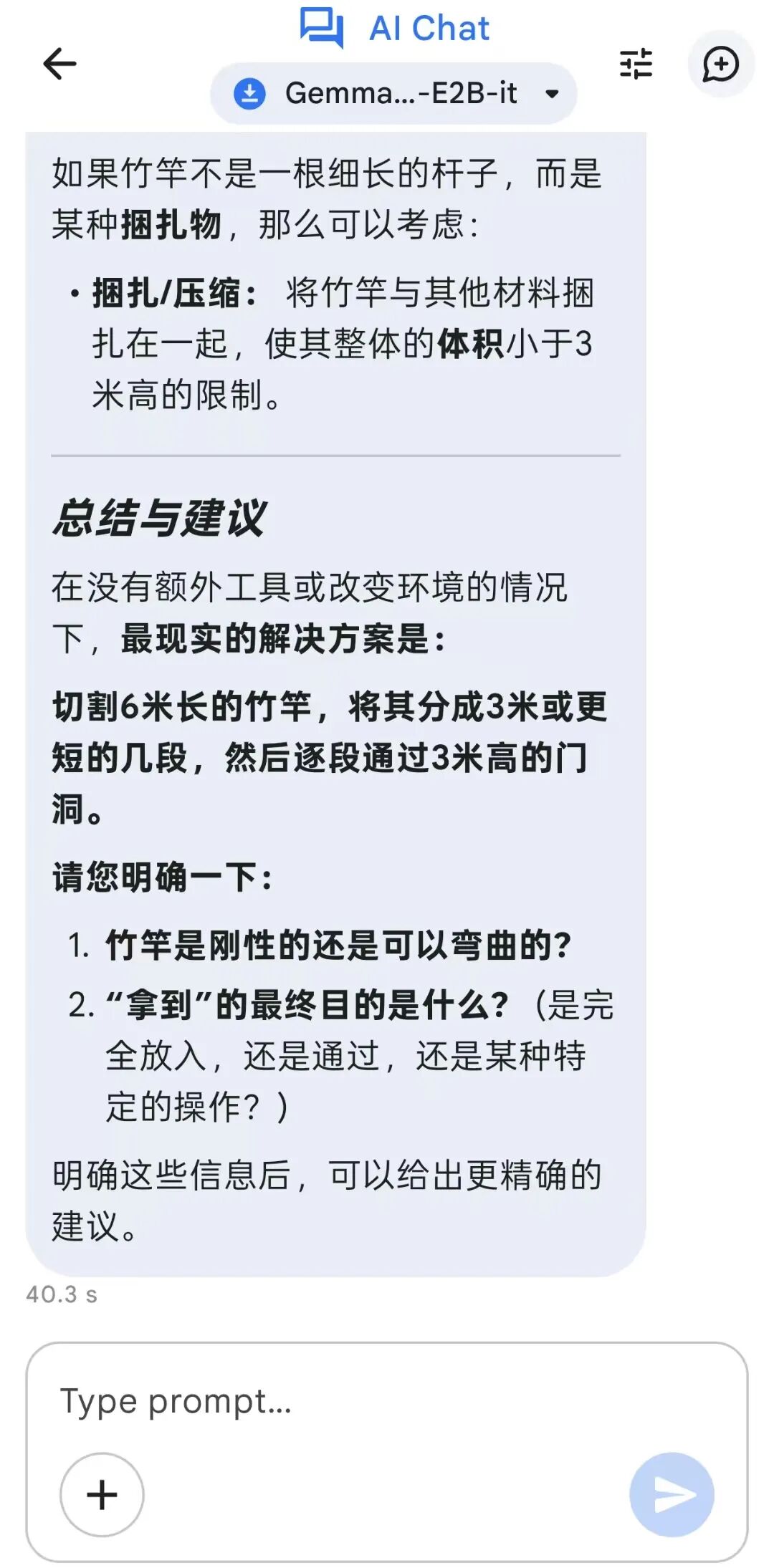

踩坑记录:有用户反馈 E2B 在处理复杂推理任务(如逻辑题)时表现一般。端侧 AI 的核心公式:合适的硬件 × 适配的模型 × 目标场景 = 端侧 AI 生产力。

方案二:电脑端(Ollama,5 分钟)

- 访问 ollama.com 下载安装(Windows/Mac/Linux 通用)

- 打开终端/命令提示符,输入命令:

ollama run gemma4:21b - 首次运行自动下载模型(约 3 小时,视网络情况),出现提示符后即可对话

方案三:RK3588 开发板

- 刷入系统(Ubuntu 或官方镜像)

- 安装 RKLLM Toolkit(官网提供一键脚本)

- 下载 Gemma 4 E2B GGUF 文件 → 使用工具转换为 NPU 格式 → 运行测试命令

苏米注:RK3588 部署建议参考 B 站最新视频教程,可视化操作更直观。

性能参考与常见问题

典型性能表现:

- 手机(NPU 优化):E2B 4-bit ≈ 15-30 tokens/s(流畅对话)

- RK3588 NPU:E2B ≈ 10-18 tokens/s(可用)

- 笔记本 RTX 4070:大模型可达 50+ tokens/s

- 笔记本 32GB 纯 CPU:约 10 tokens/s(无卡顿感)

常见问题解决:

- 内存不足导致卡顿 → 更换更小模型或尝试 2-bit 量化(新手建议先用 4-bit)

- 下载速度慢 → 使用国内 ModelScope 镜像(modelscope.cn)

- 需要多模态功能(图片/音频) → E2B/E4B 支持,直接在 App 内上传图片提问

总结与行动建议

Gemma 4 的核心价值在于让顶级 AI 模型真正运行在本地设备——零延迟、零隐私风险。无论是边缘机器人、本地 Agent 开发,还是个人学习体验,都可以从 E2B 开始尝试。

最佳实践:新手建议从手机端 Google AI Edge Gallery 入手,3 分钟即可完成首次部署,建立直观认知后再探索更复杂的硬件方案。