DeepSeek V4 发布几天后,TRAE 内置模型仍未更新支持。不过 TRAE 提供了自定义模型功能,可以手动接入第三方 API,本文以 DeepSeek V4 为例演示完整配置流程。

前置准备

配置前需要准备:

- DeepSeek 开放平台账号(充值余额后可用)

- TRAE IDE(国际版或国内版均可)

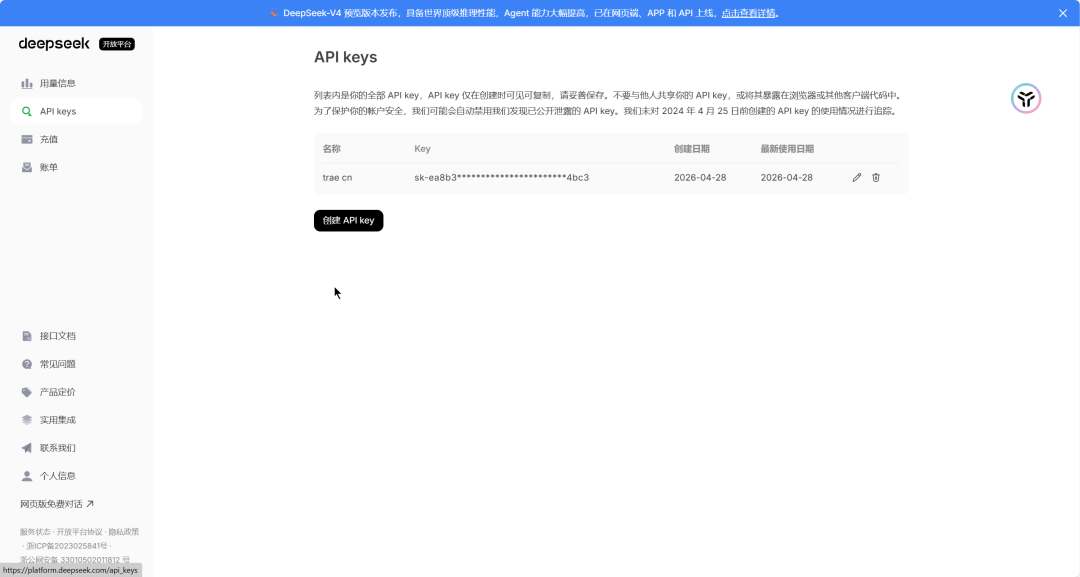

步骤一:获取 API Key

- 登录 DeepSeek 开放平台

- 进入 API Keys 管理页面

- 创建新的 API Key

- 重要:生成后立即保存,平台不再显示完整 Key

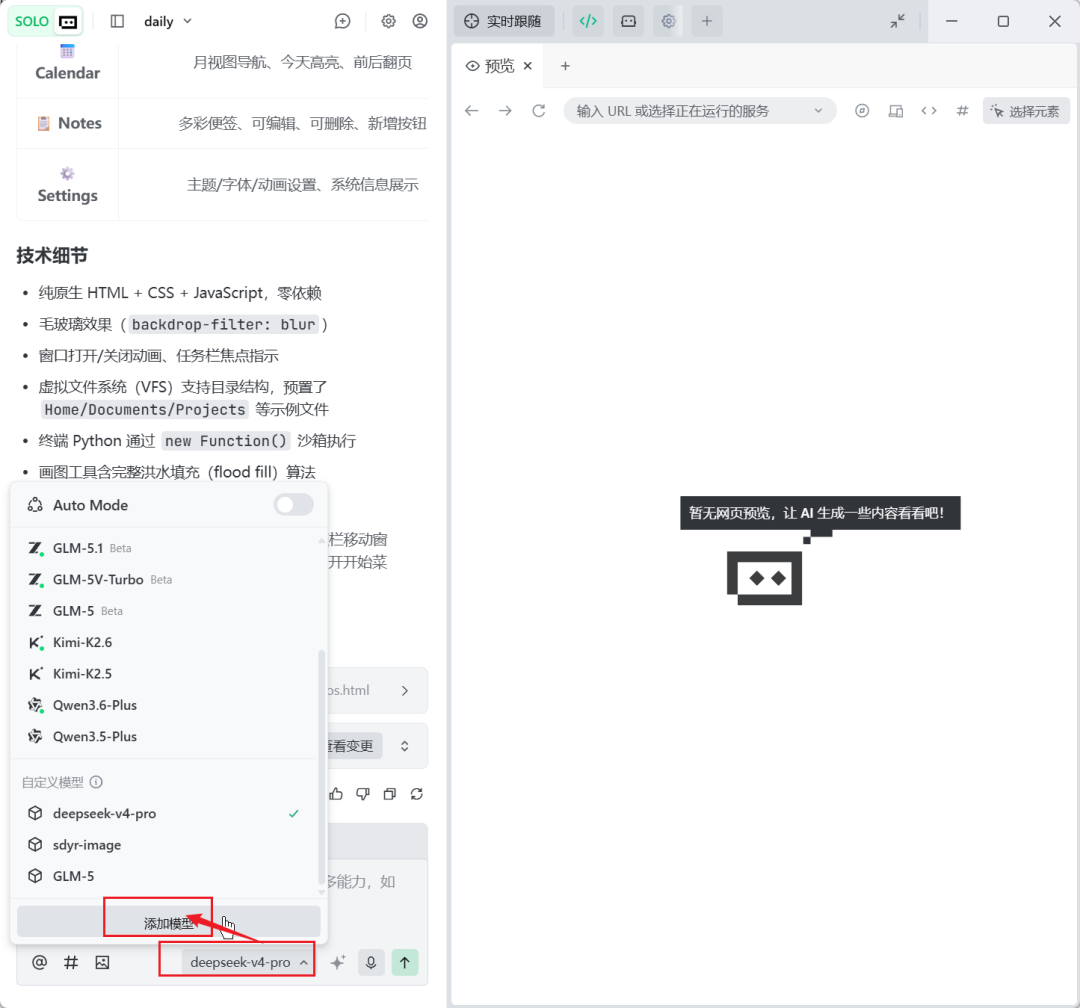

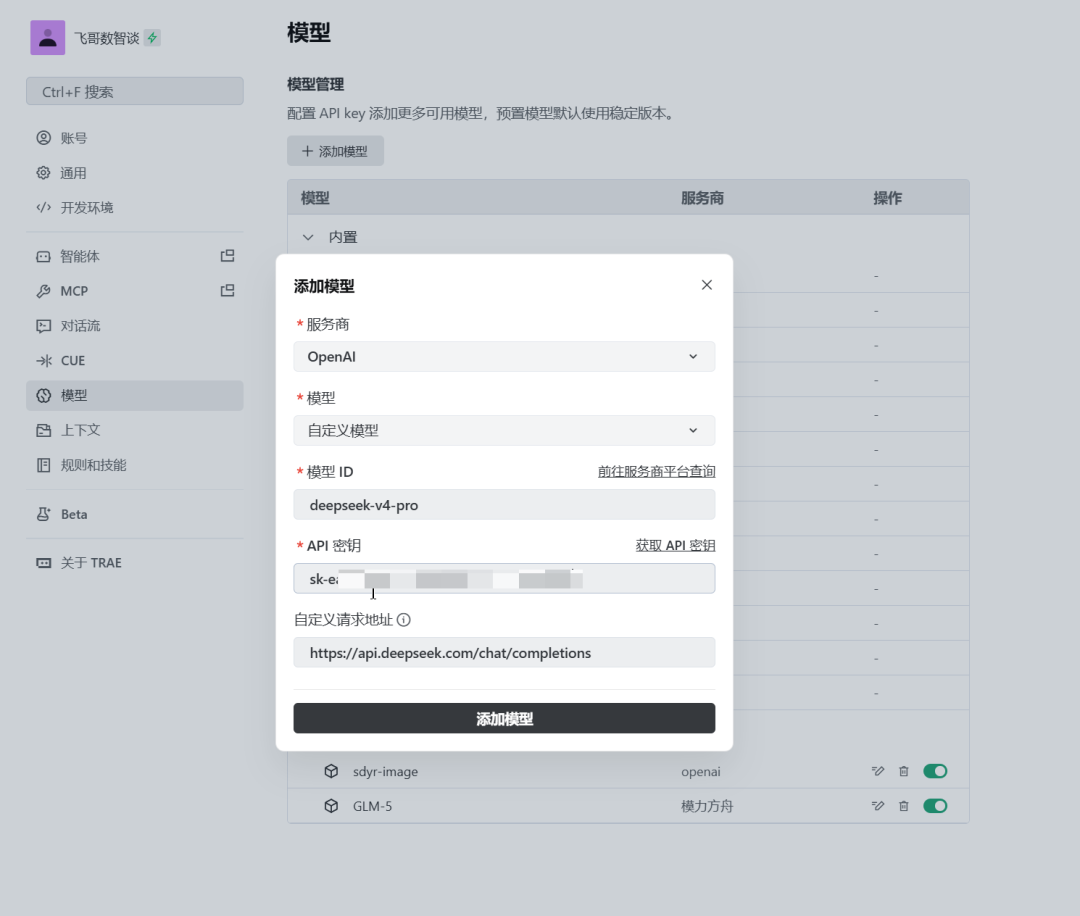

步骤二:TRAE 添加自定义模型

- 打开 TRAE,在对话框下方点击"添加模型"

- 配置参数:

| 参数 | 填写内容 |

|---|---|

| 服务商 | OpenAI |

| 模型选择 | 自定义模型 |

| 模型 ID | deepseek-v4-flash 或 deepseek-v4-pro |

| API 密钥 | 步骤一生成的 Key |

| 请求地址 | https://api.deepseek.com/chat/completions |

苏米注:模型 ID 选择 flash(非思考模式)可以避免多轮对话错误。pro 模型虽然能力强,但会触发思考模式,需要特殊处理。

请求地址说明

根据服务商选择不同地址:

- OpenAI 服务商:https://api.deepseek.com/chat/completions

- Anthropic 服务商:https://api.deepseek.com/anthropic/chat/completions

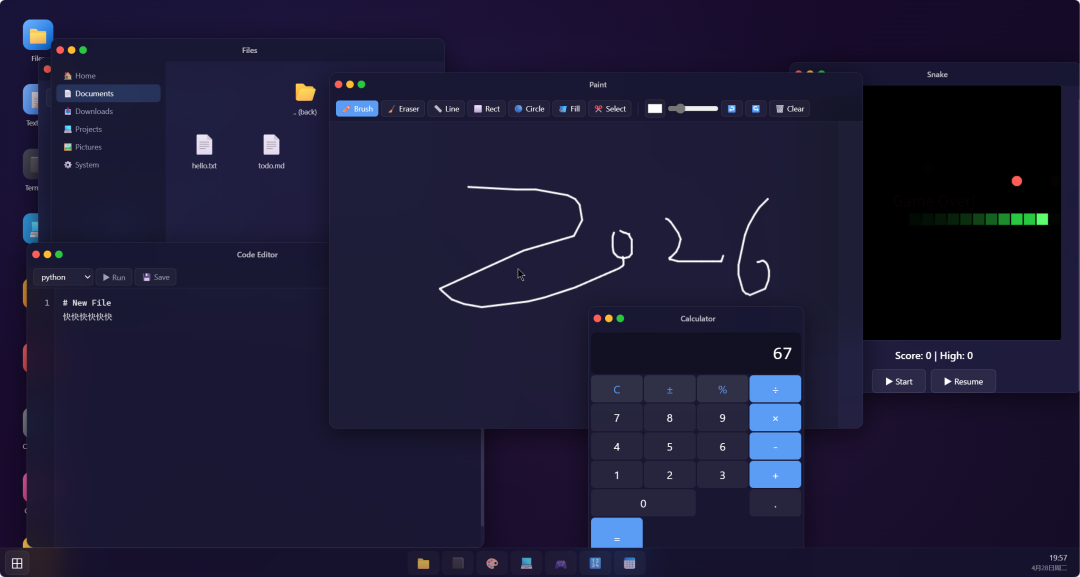

实测体验

使用 DeepSeek V4 Pro 复刻 Windows 系统 Web OS,生成包含文本编辑器、终端、代码编辑器、游戏、文件管理器、画图工具、视频编辑器等功能。

整体架构合理,各应用功能完备(绘图、游戏、编辑器均可正常使用),但 UI 还原度一般,符合 DeepSeek"理科生"定位——功能强、界面朴素。

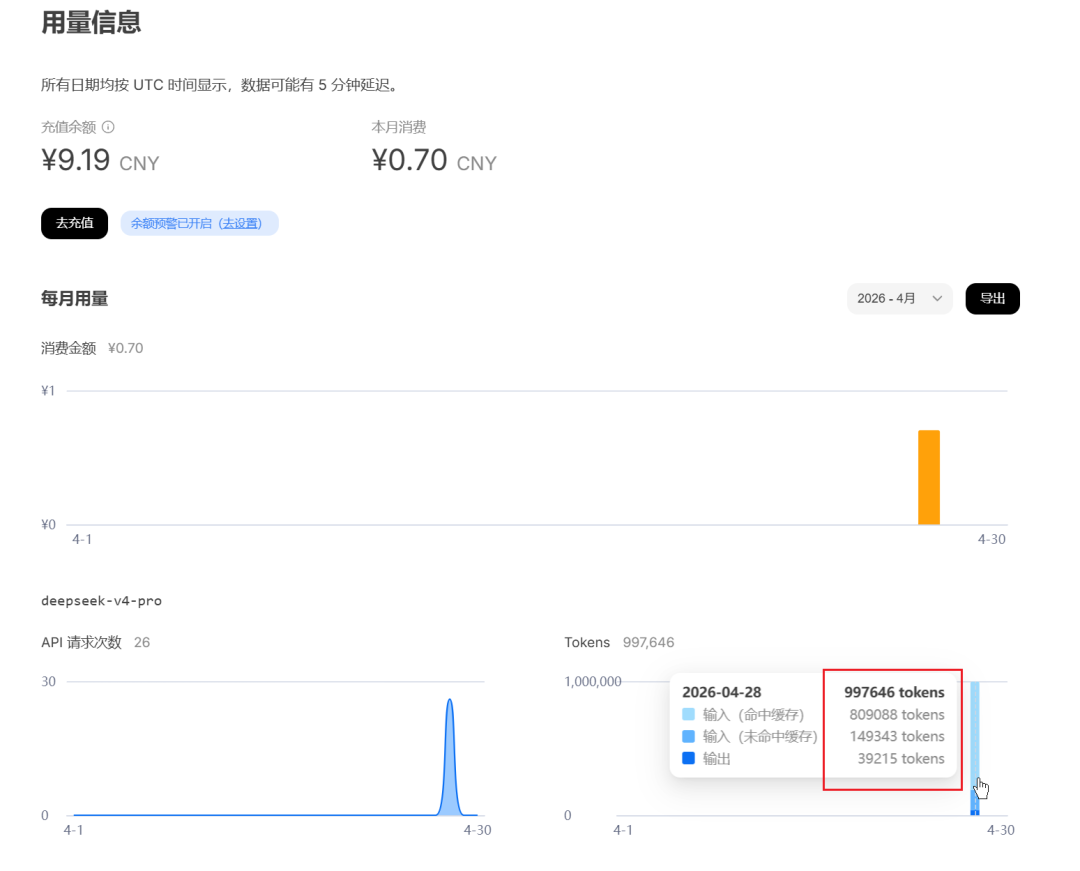

成本与缓存命中

DeepSeek 宣称价格低,实际对比数据待补充。但缓存命中率值得注意:

粗略计算缓存命中率约 81%,这意味着多轮对话中重复内容可以大幅降低 Token 消耗。

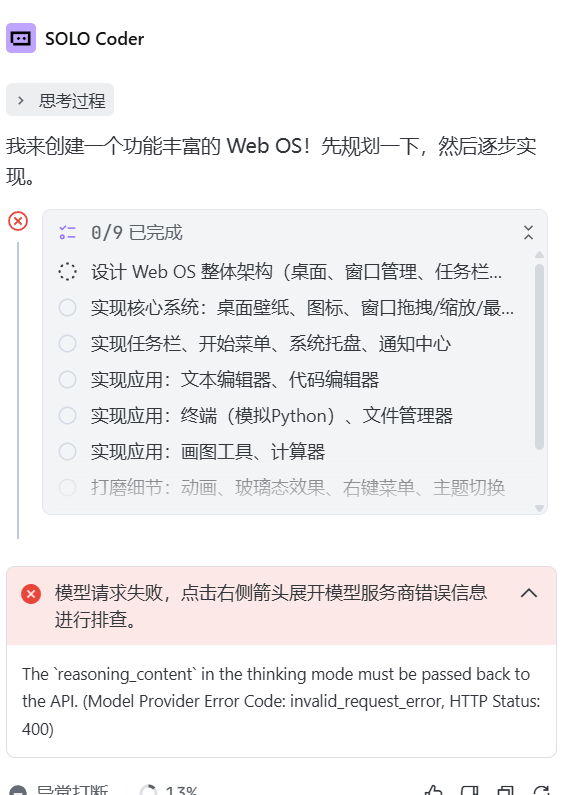

常见问题:思考模式报错

使用 deepseek-v4-pro(思考模式)可能出现以下错误:

原因:思考模式下,模型返回的 reasoning_content(思维链内容)必须原样传回 API。TRAE IDE 目前未正确处理该字段,多轮对话触发 400 错误。

解决方案:

- 方案一:模型 ID 改用 deepseek-chat(flash 非思考模式)

- 方案二:出错时新开对话(不保证有效)

- 方案三:优先使用 TRAE CN,国际版错误率高,国内版较少出现

踩坑记录:我测试时国际版连续 3 次都出现该错误,换成 TRAE CN 后基本稳定。如果必须用 pro 模型,建议在国内版操作。

声明:本站原创文章文字版权归本站所有,转载务必注明作者和出处;本站转载文章仅仅代表原作者观点,不代表本站立场,图文版权归原作者所有。如有侵权,请联系我们删除。