DeepSeek-V4 系列模型开源后,NVIDIA NIM 平台第一时间完成了接入。V4-Pro 满血版 1.6 万亿参数、V4-Flash 高速版 2840 亿参数,目前都可以在 NVIDIA NIM 上免费调用。

DeepSeek-V4 与 NVIDIA NIM

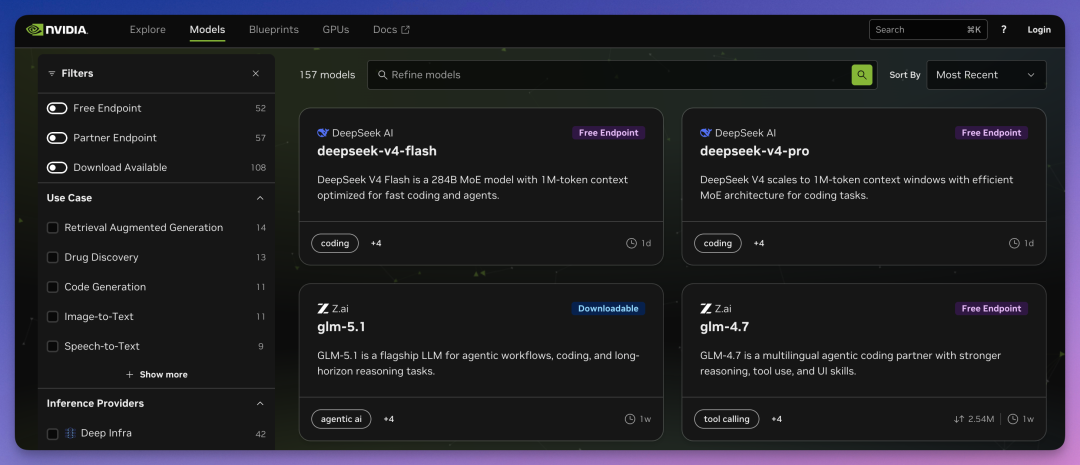

NIM(NVIDIA Inference Microservices)是英伟达推出的 AI 模型推理平台,将主流开源模型聚合在一起,统一使用 OpenAI 兼容的 API 格式调用。GLM、Kimi、MiniMax 等模型都已接入,最新加入的是 DeepSeek-V4 系列。

官方声明:「DeepSeek-V4-Pro 是全球最大的开源模型,1.6 万亿参数,可以在 NVIDIA Blackwell GPU 上免费运行。」

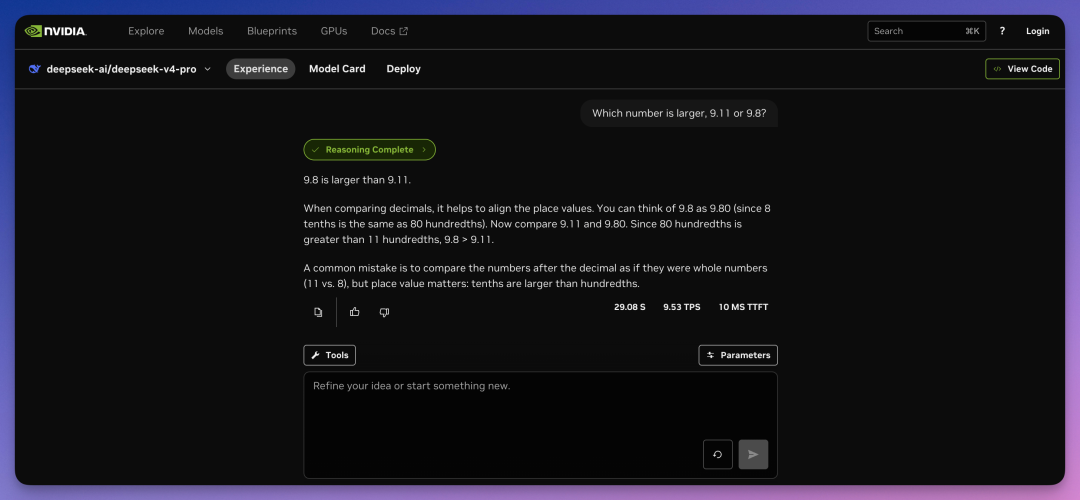

官方实测数据显示,V4-Pro 在 GB200 NVL72 上单用户每秒输出超过 150 个 token。

V4 系列参数对比:

| 模型 | 总参数 | 激活参数 | 上下文窗口 | 协议 |

|---|---|---|---|---|

| V4-Pro | 1.6 万亿 | 490 亿 | 1M | MIT |

| V4-Flash | 2840 亿 | 130 亿 | 1M | MIT |

两个版本均采用 MIT 协议开源。英伟达 NIM 平台目前不需要注册登录即可体验,但新模型上线初期资源可能较为紧张,服务偶尔不稳定,token 输出速度会有波动。日常使用完全够用。

接入教程

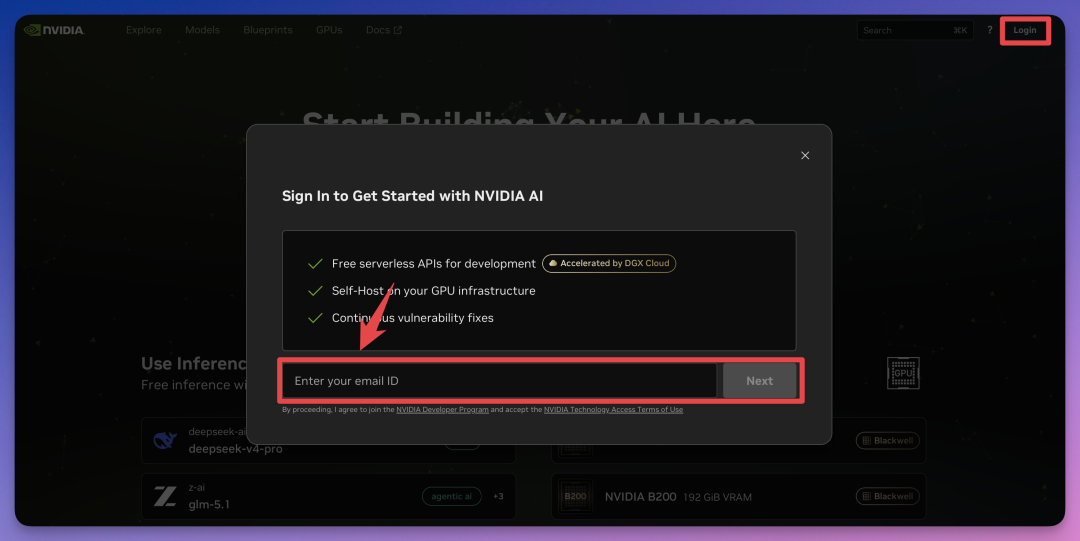

第一步:注册英伟达开发者账号

打开 build.nvidia.com,点击右上角 Login,输入邮箱。

接下来设置密码,点击 Create Account。邮箱会收到一个 6 位验证码,输入后继续。

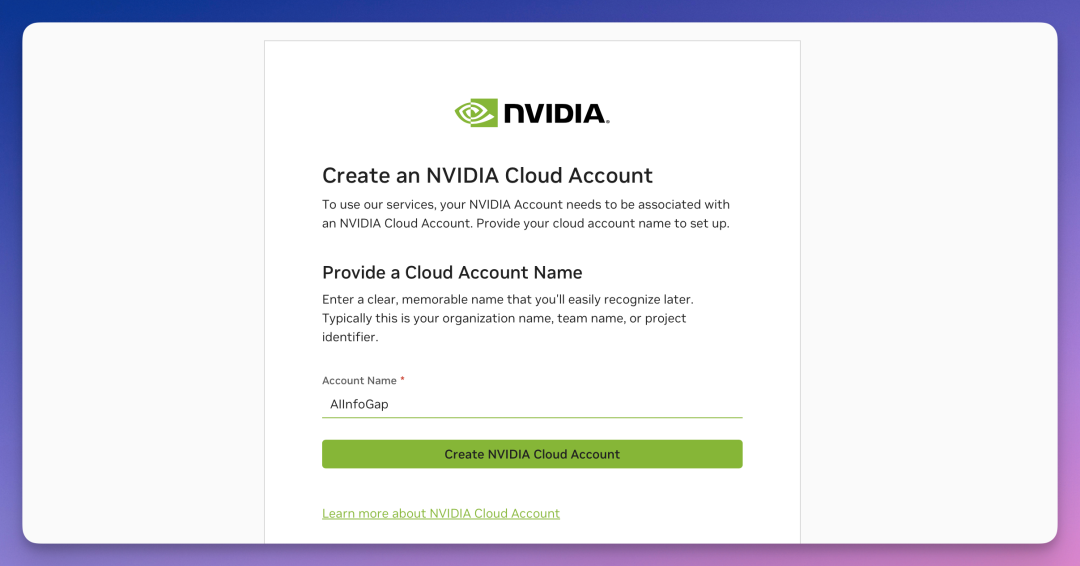

随便输入一个账户名,点击 Create NVIDIA Cloud Account。

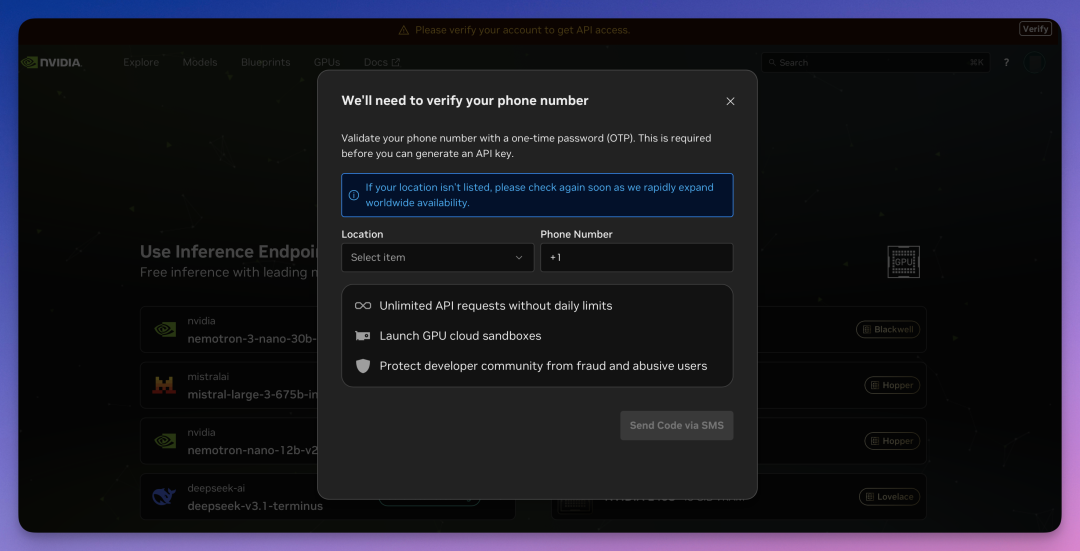

最后验证手机号,点击页面右上角的 Verify,输入手机号完成验证。国内手机号可以直接使用。

第二步:获取 API Key

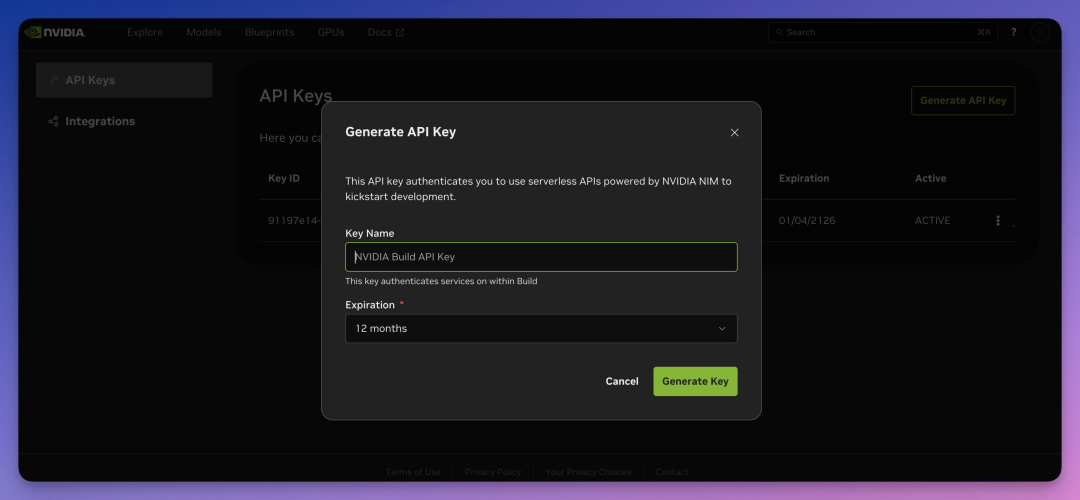

登录后,点右上角头像 → API Keys,找到 Generate API Key。

给 Key 起个名字,过期时间可以设置为永不过期(实际为 100 年),点击 Generate Key。

你会得到一个类似 nvapi-xxx_xxx 的 Key,复制保存。这个 Key 能调用 NIM 上所有免费模型,包括 DeepSeek-V4。

第三步:接入客户端

这里以 Cherry Studio 为例。如果使用 Claude Code,推荐用 CC Switch 切换 API 供应商。

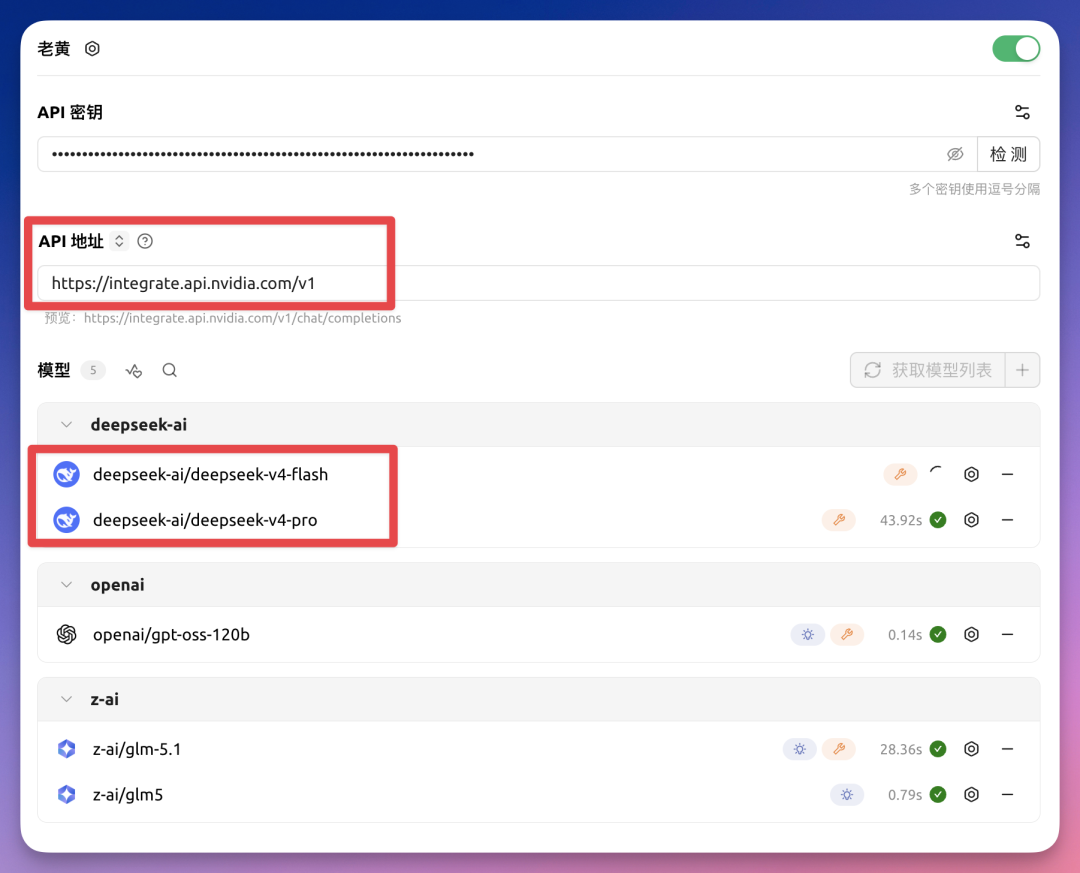

点击左下角 设置 → 模型服务 → 添加,输入「老黄」,点确定。

配置连接信息:

- API 密钥:粘贴刚刚生成的 Key

- API 地址:

https://integrate.api.nvidia.com/v1 - 模型 ID:

deepseek-ai/deepseek-v4-prodeepseek-ai/deepseek-v4-flash

可以手动添加模型,也可以点击「获取模型列表」自动添加。

配置完成后,在主界面的模型选择器中就能直接切换到 V4 了。

其他可用模型

除了 V4 系列,NIM 上还可以试用以下开源模型:

z-ai/glm-5.1、z-ai/glm-5minimaxai/minimax-m2.7moonshotai/kimi-k2.5openai/gpt-oss-120b

使用建议

V4-Pro 适合长上下文编程、文档分析等重负载场景。V4-Flash 速度更快,日常聊天完全够用。

苏米注:新模型刚上线时资源抢手是常态,高峰期速度会慢,偶尔还会限流。如果作为正式生产力工具使用,建议搭配 DeepSeek 官方 API 使用。

价格参考(DeepSeek 官方 API):

- V4-Pro(限时 2.5 折):输入命中缓存 0.025 元/未命中 3 元/输出 6 元(每百万 token)

- V4-Flash:输入 0.02 元/输出 1 元/输出 2 元

NIM 平台适合:零成本快速体验 V4 的能力水平,3 分钟即可完成配置。

官方 API 适合:需要稳定、持续使用的生产场景。