Seedance 2.0的推出引发了业内关注。

但这类生成模型有个共同的痛点:提示词质量直接决定输出效果,而大多数用户缺乏系统的工程化方法论。

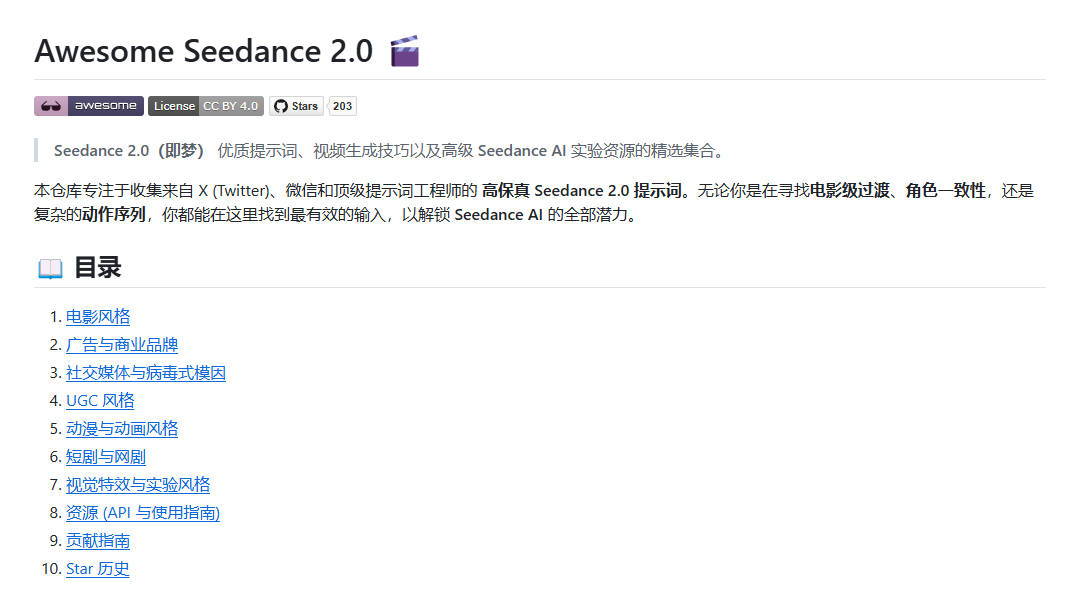

最近发现的这个开源项目 Awesome Seedance 恰好填补了这一空白。

项目概览

Awesome Seedance 是一个社区驱动的开源资源库(GitHub地址),核心定位是为Seedance 2.0用户提供结构化的提示词库、视频生成最佳实践和高阶实验资源。

项目不是简单的提示词堆砌,而是围绕"如何用有效的自然语言指令驱动模型生成预期效果"这一核心问题展开。

核心功能梳理

项目主要包含以下维度的内容:

1. 结构化提示词库

- 来源广泛:汇集Twitter、微信社区及顶级提示词工程师的经验积累

- 标准化组织:按场景类型(电影、广告、短剧、动漫、UGC等)分类存储

- 完整度高:包含场景描述、角色动作、情感表现、技术参数等多维信息

2. 典型案例与分解方案

项目提供了一个典型案例——《哪吒与敖丙冰火交锋》,展示了如何通过分幕设计来测试和优化Seedance 2.0的核心能力:

| 测试维度 | 具体场景 | 关键指标 |

| 动态一致性 | 高频、大规模动作序列 | 静止到超高速运动的过渡平滑度 |

| 属性转换 | 火焰到冰刃的无缝衔接 | 色调/材质过渡的连贯性 |

| 物理碰撞模拟 | 武器交互、粒子爆发 | 肢体崩坏率、碰撞真实度 |

| 空间逻辑 | 镜头穿透粒子层进行场景切换 | 空间连续性和场景转场流畅度 |

3. 应用场景映射

项目覆盖了主流的视频内容类型:

- 专业内容:电影预告、商业广告、宣传片

- 社交内容:短视频、UGC、Vlog素材

- 垂直领域:动漫风格渲染、短剧原型制作、特效演示

每个场景类别都配套相应的提示词模板和生成案例,降低用户的探索成本。

安装与使用方式

作为开源资源库而非软件工具,使用方式相对直接:

- 访问方式:直接clone仓库或浏览GitHub网页版本

- 内容获取:提示词以Markdown或JSON格式存储,可直接复制到Seedance平台使用

- 视频示例:仓库内包含生成结果的媒体链接或嵌入预览,支持快速验证效果

配置与定制

项目提供的提示词并非一成不变的模板,而是可复用的框架。用户可根据具体需求调整:

- 场景参数:镜头角度、光线条件、背景环境等

- 角色定义:人物属性、服装风格、动作幅度等

- 技术参数:动画帧数、运动速度、过渡时长等

结尾总结

Awesome Seedance解决的不是"如何用Seedance生成视频"这类入门问题,而是"如何系统地优化提示词以获得符合预期的高质量输出"这一专业化问题。

这个项目特别适合以下用户群体:

- 内容创作者:需要快速获取可用提示词模板

- 提示词工程师:需要学习Seedance特定的优化方法论

- 视频制作工作室:寻求降低AI生成内容的调试周期

- AI爱好者:想理解视频生成模型的能力边界

如果你正在探索AI视频生成的落地应用,或者希望提升Seedance的使用效能,不妨先从这个资源库开始。

它或许不会给你一个"一键生成"的解决方案,但能帮助你更深刻地理解模型的工作逻辑,从而做出更有针对性的创意决策。

声明:本站原创文章文字版权归本站所有,转载务必注明作者和出处;本站转载文章仅仅代表原作者观点,不代表本站立场,图文版权归原作者所有。如有侵权,请联系我们删除。