数据来源:XSCT Arena(xsct.ai)|报告日期:2026 年 3 月 18 日

本推文由 xsct.ai 自动化生成并发布。

一、执行摘要

MiniMax-M2.7 为 MiniMax 旗舰文本模型,在 XSCT Arena 的 xsct-l 综合得分为 84.5,位列全场第 #11,整体处于第二梯队前列。

其能力画像鲜明:文字生成强、复杂推理弱。在润色与摘要等文字任务上,表现超过排名更高的 kimi-k2.5;但在复杂逻辑与数学竞赛场景中出现系统性失稳与崩溃。

- 综合得分:84.5(xsct-l 第 #11;日常 85.6 / 专业 84.4 / 极限 83.4)

- 最强维度:L-Polish 润色(Hard 档 90.2,优于其 24 维度均值)

- 最弱维度:L-Math 数学竞赛(Hard 15.0,出现推理循环崩溃,全场最低)

- 覆盖:24 个维度,全维度覆盖,天花板均为 Hard 档(ceiling=3)

- 系列进化:较 M2.1 综合分约 +1.7,极限档提升尤为明显

二、研究背景与方法论

2.1 评测平台说明

本报告使用 XSCT Arena(xsct.ai)公开评测数据。平台采用 LLM-as-a-Judge 方法,以三款 Judge 模型加权评分:

- Claude Sonnet 4.6(权重 50%)

- Gemini 3 Flash(权重 30%)

- Kimi(权重 20%)

每个维度设置三档难度:基础(Basic)模拟日常使用、中等(Medium)模拟专业需求、困难(Hard)测试能力上限(极限场景)。

2.2 公平对比原则

- 仅纳入各模型均有数据的公平用例集进行横向对比。

- 某模型在某用例缺数据时,该用例不进入跨模型排名,仅做单模型分析。

- 每个维度以 3 条以上用例的均值作为维度结论,单一用例不代表维度定论。

- 得分显著性:≤2 分为误差范围;5–9 分为有意义差距;≥10 分为明显优势。

2.3 被评模型与对比模型

三、模型基本档案

- 供应商:MiniMax(上海稀宇科技有限公司)

- 综合得分:84.5(XSCT Arena xsct-l)

- 日常 / 专业 / 极限:85.6 / 84.4 / 83.4

- 排名:#11(xsct-l 全模型排行,共 30 款在测)

- 维度覆盖:24 个维度,天花板均为 Hard 档(ceiling = 3)

- 定价:暂未公布(参考 M2.1:输入 ¥2.09/M,输出 ¥8.36/M)

系列内部对比:M2.7 相较 M2.1 / M2.5 综合分约 +1.7,极限档提升最明显(+2.1),表明该版本着力增强专业与极限场景能力。

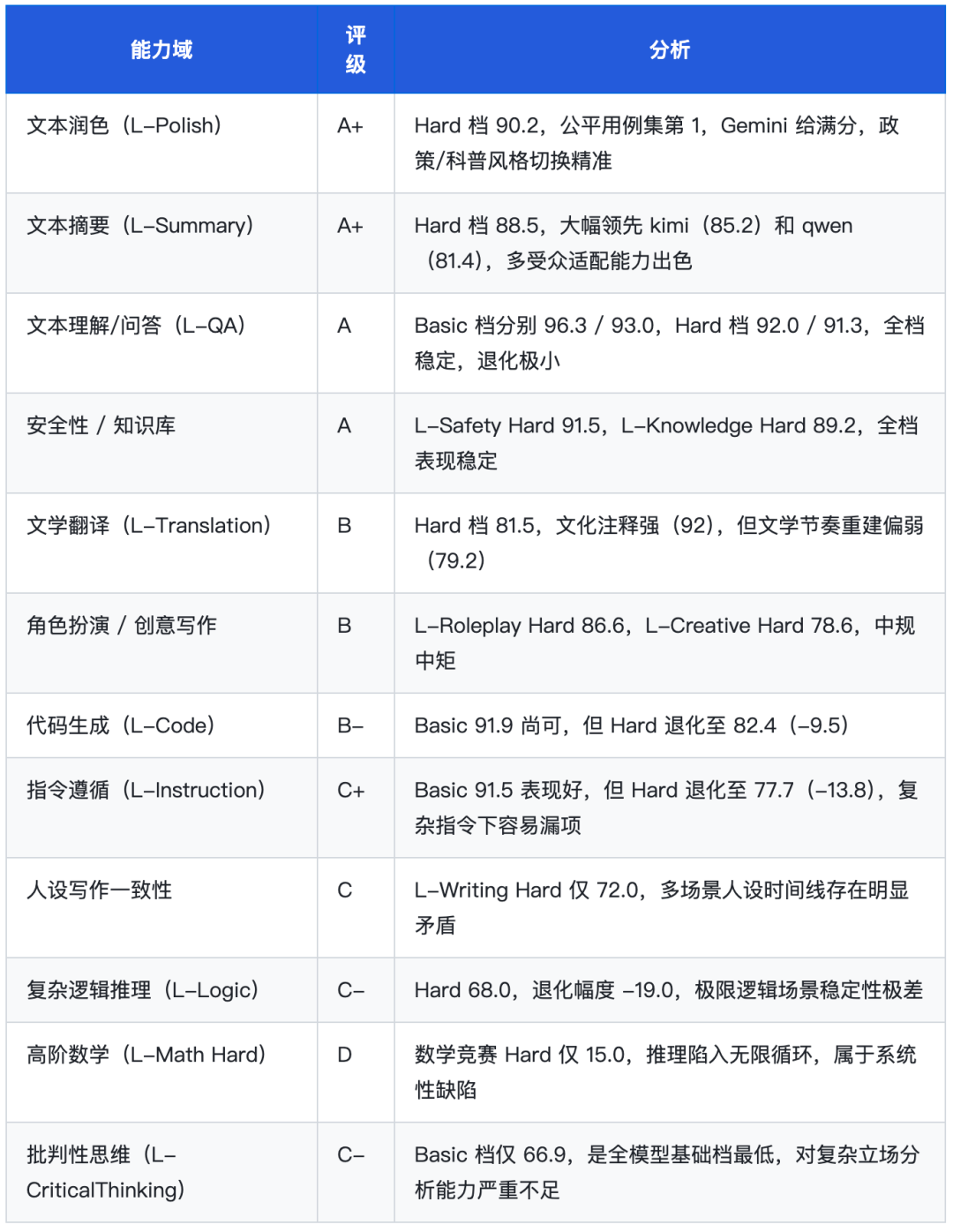

四、全景维度评分

4.1 24 维度 Basic / Medium / Hard 全量得分

4.2 退化规律总结

存在明显的“难度失速”特征:

- 退化显著:逻辑(-19)、数学(-18.7)、指令遵循(-13.8)从基础到困难档均大幅下滑,极限场景稳定性不足。

- 反向提升:润色(+0.6)与摘要(+2.8)在困难档反而略优于基础档,显示文字写作类任务在高难度下依旧稳健。

五、核心场景深度分析

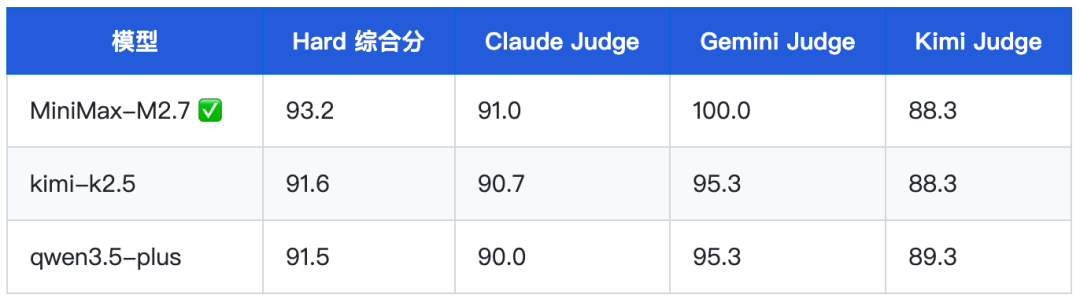

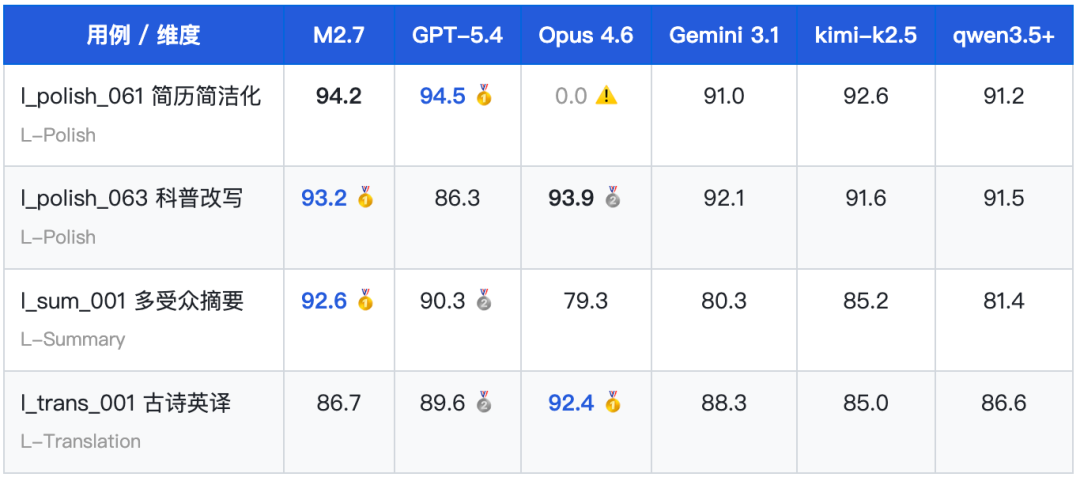

5.1 L-Polish 润色:学术摘要科普化改写(l_polish_063)

MiniMax-M2.7 得分 93.2,领先 kimi-k2.5(91.6)约 1.6 分。Gemini Judge 给出满分 100.0,认为其风格切换精确,能够在政策简报与中学生科普间无缝转换。

Gemini 评语:“该生成结果展现了极高的专业水准。模型不仅完美执行了字数硬约束,更在信息架构设计上展现了对不同受众需求的深刻理解。研究者版本严谨客观,管理者版本务实且具有前瞻性,公众版本生动形象,三个版本在保持事实一致性的前提下,实现了高质量的风格迁移,是高质量的 AI 评测样本。”

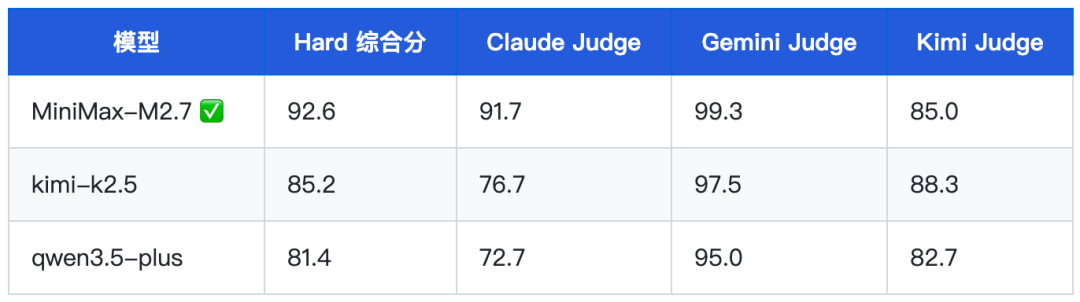

5.2 L-Summary 摘要:多受众学术摘要(l_sum_001)

MiniMax-M2.7 以 92.6 分明显领先 kimi-k2.5(85.2,+7.4)与 qwen3.5-plus(81.4,+11.2)。其中 kimi-k2.5 出现数据错误(将 AUC 0.97 误记为“准确率 97%”),而 M2.7 保持了数据表述的精确性。

Claude 评语:“该候选输出在三个评分维度上均表现优秀。信息准确性方面,关键数据完整无误,未出现幻觉或重大遗漏;受众适配方面,三个版本在专业深度、商务视角、科普易懂性上实现了精准的风格迁移,用词与句式差异显著;约束遵守方面,字数控制精准,格式规范清晰。”

5.3 L-Translation 翻译:古诗英译(l_trans_001)

三模型得分接近。MiniMax-M2.7 在文化注释深度(92.0)略占上风,但在文学节奏重建(79.2)上短板明显:存在“of”悬挂行末与断句影响气势的问题。

Claude 评语(关于文学节奏):“‘The waves wash clean through ages past / The dashing masters of ten thousand years’ 两行断句使‘浪淘尽’与‘千古风流人物’的语义连贯性被割裂。最后两行 ‘They say it is, the Red Cliff of / Zhou Lang’ 中 ‘of’ 悬挂于行末,造成不自然的断裂,破坏了诗性语言的流动性。”

5.4 L-Writing 写作:人设一致性问题(l_write_001)

写作维度的困难档 72.0 分为除数学竞赛特殊用例外的最低分。在“多场景人设一致性写作”用例中仅得 81.7,且 Judge 分歧极大(Gemini 95.0,Kimi 65.0)。

Kimi 评语(人设一致性 55/100):“存在严重事实矛盾:女儿年龄矛盾——任务一写‘女儿小禾出生后’移居成都,任务二写‘四岁女儿小禾’,结合‘去年四月搬到成都’,若女儿已四岁则出生在北京,但‘出生后’移居暗示当时刚出生,时间线混乱。自查表将错误表述强行解释为一致,属于强行圆场。”

5.5 L-Math 数学竞赛:推理循环崩溃(l_math_008)

该部分为本次测评的关键发现。MiniMax-M2.7 在数学竞赛困难档仅 15.0 分(Claude 10.0 / Gemini 10.0 / Kimi 35.0),出现推理过程“无限循环”的严重问题。

Claude 评语:“该回答存在根本性的结构缺陷,主要表现为:推理过程陷入无限循环,大量重复相同文本(‘重新检查 n=4 的情况’重复数千次),完全未能完成题目要求的四个任务……文本生成失控,丧失了作为数学证明的基本可读性和逻辑连贯性。综合来看,该回答未能满足任何一个评分维度的基本要求,属于严重不合格的回答。”

该现象在 L-Logic 逻辑维度(Hard 68.0)中亦有体现,显示 M2.7 在复杂多步骤推理方面存在系统性稳定性缺陷。

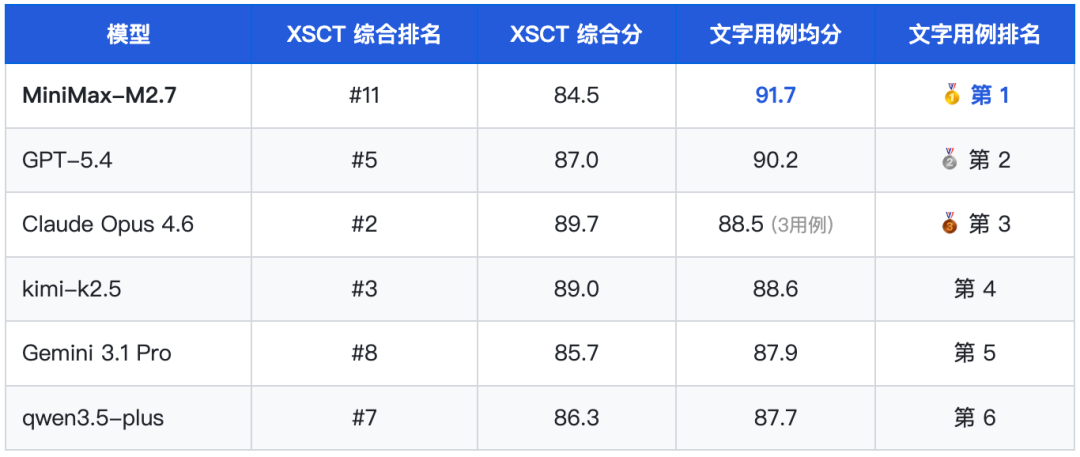

六、横向竞品对标(公平用例集)

基于六款模型均有完整 Hard 档数据的 4 条公平用例集

(注:Claude Opus 4.6 在 l_polish_061 因评分异常得 0 分,其均分仅含 3 个有效用例)

MiniMax-M2.7 在文字创作用例中的均分为 91.7,排名第一,超过:

- GPT-5.4(90.2,#5)

- Claude Opus 4.6(88.5,#2)

- kimi-k2.5(88.6,#3)

这一“排名倒挂”说明:M2.7 的综合榜表现受推理相关维度拖累,而其文字生成能力在实战中被低估。

七、综合评估:优劣势矩阵

八、场景选型建议

强烈推荐

- 文案润色与风格改写——Hard 档全场最佳,政策/科普/商务多风格切换精准,严格遵守字数,适合内容运营与编辑团队。

- 多受众摘要生成——Hard 档显著优于 kimi 与 qwen,适用于需同步产出研究者/管理者/公众版的内容生产。

- 文章/文档理解与问答——L-Comprehension / L-QA 全档稳定 90+,可靠性高。

- 知识库 QA / RAG 应用——L-Knowledge Hard 89.2,安全性 91.5,适合企业知识管理系统。

- 角色扮演 / 客服场景——L-Roleplay Hard 86.6,适合 NPC 对话与客服 Bot。

需谨慎

- 数学/竞赛题解答——数学竞赛 Hard 仅 15 分,存在推理循环崩溃风险,极限数学场景不可依赖。

- 复杂逻辑推理/多步骤论证——L-Logic Hard 68.0,退化 -19,易在长链推理中迷失。

- 复杂指令跟随(嵌套/多约束)——L-Instruction Hard 77.7,漏项率偏高。

- 多场景人设一致性写作——L-Writing Hard 72.0,时间线管理与跨文档自洽性存在缺陷。

- 批判性分析/辩论辅助——L-CriticalThinking Basic 仅 66.9,对对立立场分析薄弱。

九、结论与展望

结论一:文字创作场景的隐藏强者。在润色、摘要、翻译三类文字生成公平用例中,M2.7 均分 91.7,领先 kimi-k2.5(88.6)3.1 分、领先 qwen3.5-plus(87.7)4.0 分,且 4 条用例均居首。这与综合排名(#11)形成反差,表明拖累来自推理相关维度而非文字类本身。对重度文字生产用户而言,M2.7 是综合榜中被低估的选择。

结论二:润色与摘要是差异化优势。L-Polish(Hard 90.2)与 L-Summary(Hard 88.5)构成核心壁垒。在学术科普改写与多受众摘要中,既能严守字数,又能完成风格迁移(学术→政策→科普)并保持数据准确性。多项用例中 Gemini 给出 100 分或接近满分,说明能力已达当前主流水准上限。

结论三:复杂推理存在系统性缺陷。L-Logic Hard 68.0(退化 -19)、L-Math 竞赛 Hard 15.0(推理崩溃)、L-Instruction Hard 77.7(退化 -13.8)共同指向:在多步骤连贯推理的极限场景中稳定性不足。数学竞赛用例中的“无限循环”并非个例,而是稳定性控制缺失的集中体现。

结论四:文字创作内部仍有分化。润色(+0.6)与摘要(+2.8)在 Hard 档优于基础档,体现“越难越稳”;写作(-10.9)在 Hard 档显著退化,时间线与人设一致性管理薄弱;翻译(-6.0)在文学节奏重建上为短板。建议区分“改写型”与“原创型”任务:改写润色可放心使用,原创人设写作需加强人工审核。

改进建议(优先级):

- 最高优先级:修复推理循环崩溃——聚焦数学竞赛与复杂逻辑场景的稳定性控制。

- 高优先级:提升指令遵循在 Hard 档的稳定度——降低复杂嵌套指令下的漏项率。

- 中优先级:加强多场景人设一致性管理——尤其是跨文档时间线追踪;引入结构化一致性校验。

- 中优先级:补齐批判性思维基础能力——针对 L-CriticalThinking Basic 66.9 的短板进行数据层面强化。

十、附录:数据来源与参考链接

- MiniMax-M2.7 详情页:https://xsct.ai/model/MiniMax%20/%20MiniMax-M2.7

- kimi-k2.5 详情页:https://xsct.ai/model/kimi-k2.5

- qwen3.5-plus 详情页:https://xsct.ai/model/qwen3.5-plus-2026-02-15

- 评测平台:https://xsct.ai

- 方法论说明:https://xsct.ai/methodology

数据来源:XSCT Arena(xsct.ai)|报告日期:2026 年 3 月 18 日|本报告基于平台公开评测数据,所有结论均以数据为支撑,仅供参考。