最近在体验各类AI编程工具时,我发现了一个普遍现象:它们在代码生成速度上确实优秀,但质量控制的环节经常被跳过。写完代码就匆匆上线,测试文档各种"我稍后补上",安全审查更是形同虚设。这不是工具的问题,而是缺少一套可执行的、能够制约AI行为的工作规范。直到我发现了Addy Osmani开源的Agent Skills项目,才意识到——Google早就把这套工程文化标准化了。

项目概览

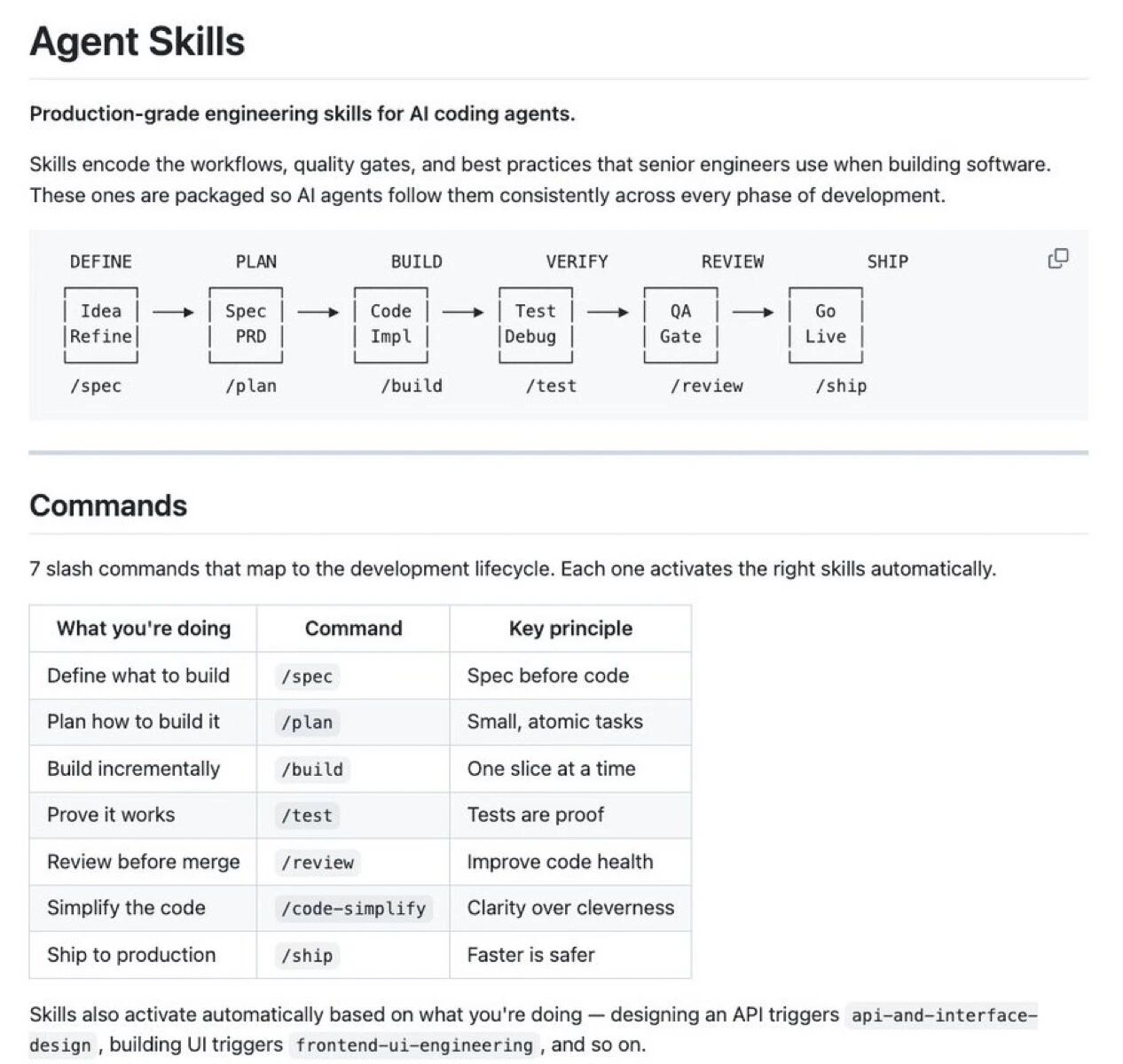

Agent Skills是Google资深工程师Addy Osmani基于团队实践总结的开源项目。

核心逻辑很直白:将Google的工程规范和质量卡点,以"技能包"的形式嵌入到AI Agent中,让AI在代码生成的全流程中都遵循预定的标准,而不是在效率与质量间随意选择。

这个项目目前包含19个结构化技能,涵盖从需求分析到生产发布的完整开发周期:

- Define阶段:需求分析、PRD编写

- Plan阶段:任务拆解、工作量评估

- Build阶段:增量开发、API设计、前端工程规范

- Verify阶段:TDD驱动开发、调试流程、浏览器兼容性测试

- Review阶段:代码质量评审、安全加固、性能优化

- Ship阶段:Git工作流、CI/CD配置、文档生成、版本发布

核心机制:工程文化的硬约束

Agent Skills的设计思路不是"建议"AI这样做,而是通过以下三个核心原则形成强制约束:

- "Spec before code" — 规格文档必须先于代码编写完成

- "Tests are proof" — 测试用例是功能正确性的唯一证明

- "Faster is safer" — 更快的开发前提是更全面的质量保障

每个技能内部都内置了一张"反借口清单"。当AI试图以"这个需求很简单不用写文档""我后面再补测试""这里可以先跳过安全审查"等理由绕过流程时,这些预设的反驳方案会直接触发,强制AI回到标准流程。

使用方式与命令体系

项目提供了7条快捷命令,对应开发周期的各个环节:

| 命令 | 对应阶段 | 核心功能 |

|---|---|---|

| /spec | Define | 定义要构建的需求和设计规范 |

| /plan | Plan | 拆解任务、制定技术方案 |

| /build | Build | 逐步增量开发,按照规范编写代码 |

| /test | Verify | 编写测试用例,验证功能正确性 |

| /review | Review | 代码审查,检查质量和安全问题 |

| /code-simplify | Review | 代码重构和优化 |

| /ship | Ship | 发布到生产环境,更新文档和版本 |

输入对应命令后,AI就会激活相应的技能包,自动按照Google工程标准执行该阶段的工作。

安装与集成

安装非常简洁,一条命令搞定:

npx skills add addyosmani/agent-skills项目支持多个主流Agent平台:

- Claude Code(官方推荐)

- Cursor IDE

- Windsurf

- GitHub Copilot

- 任何支持Markdown的代理工具

这意味着无论你使用哪个AI编码工具,都可以通过导入这套技能包来规范AI的工作流程。

应用场景与适用人群

这个项目特别适合以下场景:

- 团队协作项目:需要统一代码标准和质量控制流程

- 生产环境代码:对稳定性、安全性有较高要求

- AI辅助开发:希望AI生成的代码能直接符合企业规范

- 新人使用AI编程工具:学习工程最佳实践的参考框架

相比直接使用原生AI编程助手,Agent Skills通过强制性的流程约束,能显著降低代码质量风险。

对标与思考

市场上还有其他类似的AI工作流规范工具,比如Anthropic的自身提示词工程文档、一些企业内部的AI Governance框架等。但Agent Skills的独特之处在于:

- 来自Google这样有成熟工程文化积淀的团队

- 不仅规范流程,还通过"反借口"机制预防AI的常见偷懒行为

- 开源可复用,能快速集成到现有的开发工具链

- 命令化设计,学习成本低

结尾总结

在我使用AI编程工具的这段时间里,我越来越意识到:AI的能力本身已经足够强大,真正的瓶颈在于如何让它们在高效的同时保持可靠性。Agent Skills提供的不是新的AI模型,也不是更聪明的算法,而是一套可以嵌入开发流程的"工程文化标准化工具"。

它的价值在于将那些容易被忽视的工程规范——文档、测试、审查、安全——变成了AI无法绕过的强制检查点。这对于想要在生产环境中大规模使用AI辅助开发的团队来说,是一个实际可用的解决方案。

如果你正在考虑如何规范AI在团队中的使用,或者希望AI生成的代码能更直接地符合企业标准,这个项目值得尝试。