最近在浏览GitHub时发现了一个有意思的项目——由清华THUNLP、中国人民大学、面壁智能等机构联合开源的EdgeClaw。

它本质上是OpenClaw的安全增强版本,但核心创新在于:通过本地隐私中间件和边缘推理能力,让数据完全不离开本地机器。

这对于需要处理敏感信息的企业和个人用户来说,解决了一个实际的痛点。

EdgeClaw vs OpenClaw:差异化定位

先简单说下关系。OpenClaw本身已经支持20+IM接入、浏览器操作、文件读写、50+Skills等完整的Agent功能栈。

但它的推理依赖云端大模型API调用——你的消息、文件、工具执行结果都会上传到云服务处理,这意味着敏感数据(密码、密钥、商业信息)实际上经过了第三方。

EdgeClaw在保留OpenClaw所有功能的基础上,核心增加了三层能力:

- GuardClaw隐私路由中间件:自动对消息进行敏感度分级,决定走本地还是云端处理

- 本地模型推理支持:集成面壁MiniCPM全系列轻量化模型,通过Ollama运行

- EdgeClaw Box硬件方案:预装配置的一体化硬件,开箱即用

核心机制:三级自动分级 + 双引擎检测

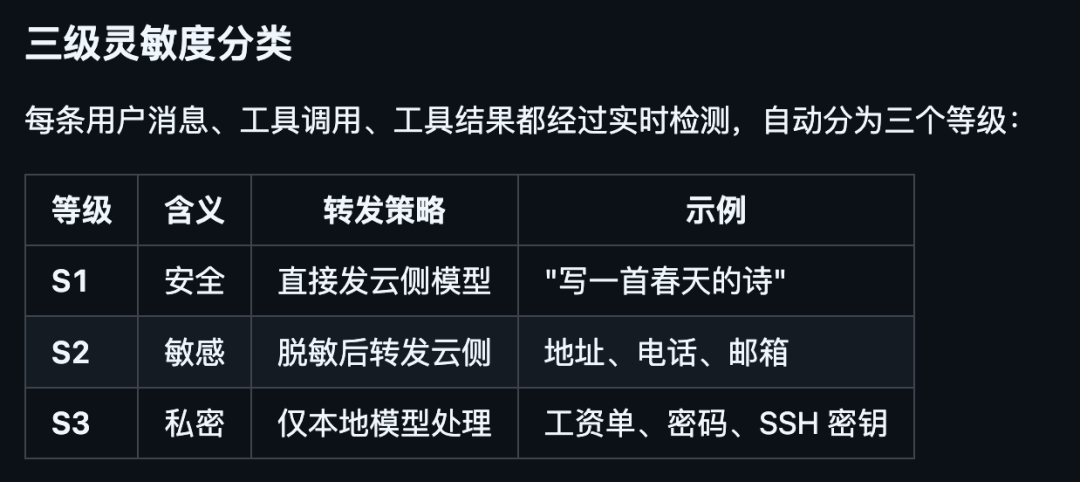

最有意思的是GuardClaw的工作逻辑。它对每条消息、每次工具调用、每段Agent输出都自动分为三级:

| 分级 | 定义 | 处理方式 |

|---|---|---|

| S1(安全) | 无敏感信息,公开可处理 | 直接发送云端大模型 |

| S2(敏感) | 包含部分敏感数据 | 脱敏后转发云端 |

| S3(私密) | 包含密码、财务、医疗等关键隐私 | 本地模型处理,绝不外传 |

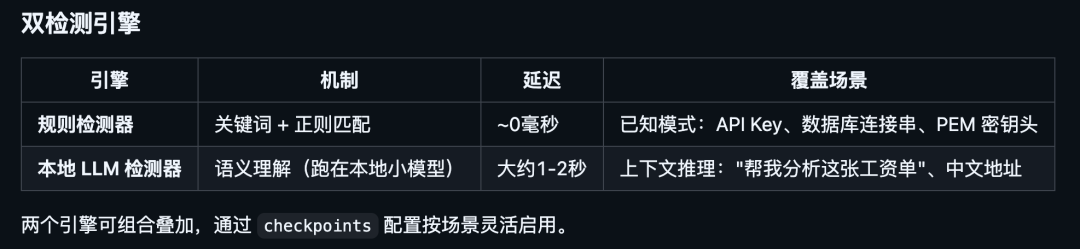

分级检测采用双引擎并行方案:

- 规则引擎(毫秒级):正则+关键词扫描,快速识别密码、密钥、身份证号等明确模式

- 本地模型引擎(1-2秒):用MiniCPM做语义理解,处理微妙情况。比如"帮我看看工资单有没有问题"这类消息,虽然没有敏感词,但模型能理解其中的财务隐私属性,自动标为S3

整个过程全自动,用户无需手动切换。如果要求最严格的隐私政策,也可以配置全量走本地模型处理。

装好 Ollama 之后,一条命令就能跑起来:

ollama run openbmb/minicpm4.1

全链路保护设计

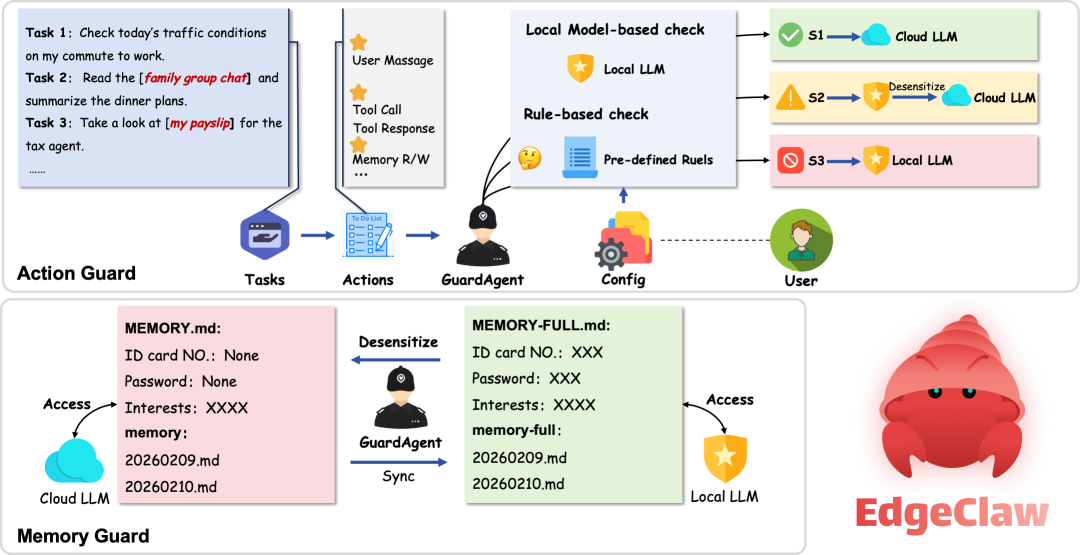

一个细节值得注意——AI Agent不是简单的一问一答,而是完整的执行流程(读文件→调工具→生成子任务→写入记忆)。

EdgeClaw在整个流程中设置了8个核心检查点:

- 消息到达时路由分流

- 工具调用拦截

- 结果检查

- 会话记录隔离

- 记忆同步保护

- 出站消息扫描

- 子Agent隐私注入

特别是记忆隔离机制——云端模型只能看到脱敏后的对话历史,完整记忆仅本地模型可访问,从源头上杜绝了隐私数据通过上下文窗口泄露的可能。

本地推理与硬件适配

EdgeClaw推荐使用面壁自研的MiniCPM系列模型(MiniCPM 4.1、MiniCPM-V等),通过Ollama框架运行。

硬件门槛不高,量化版通常8GB内存即可运行。

项目还提供了EdgeClaw Box硬件方案——预装配置好的一体化产品,已适配松果派、英伟达DGX Spark、苹果Mac Mini等,插电即用,无需部署经验。这个面向非技术用户的周边产品,让边缘计算方案的使用门槛大幅降低。

应用场景适配

从功能定位看,EdgeClaw适合以下场景:

- 企业内部AI助手:处理商业机密、客户数据,数据完全本地化

- 医疗/金融领域:合规性要求高,需要满足数据隐私法规

- 离线/低网络环境:可独立运行,无需持续云连接

- 成本优化:简单任务用本地小模型(零Token成本),复杂任务才调云端大模型

相似项目对标

市面上也有类似的隐私保护Agent框架,如Ollama + LM Studio的本地推理方案,但它们通常需要用户手动管理数据流向。

EdgeClaw的优势在于自动分级路由,让用户无需理解技术细节就能获得隐私保护。相比完全本地部署的方案,它又通过云边结合保留了大模型的推理能力。

总体评价

作为产品经理,我对EdgeClaw的产品思路比较认可——它没有在隐私和AI能力之间设置非此即彼的选择,而是通过技术手段让两者兼得。自动分级机制降低了用户的使用心智负担,云边结合的架构在实际应用中也更灵活。

唯一需要关注的是生态成熟度——MiniCPM模型族虽然轻量化做得不错,但在特定行业垂直任务的表现仍需观察。不过作为开源项目,这个方向值得跟进。如果你的应用场景涉及敏感数据处理,EdgeClaw提供了一个可行的技术路线。