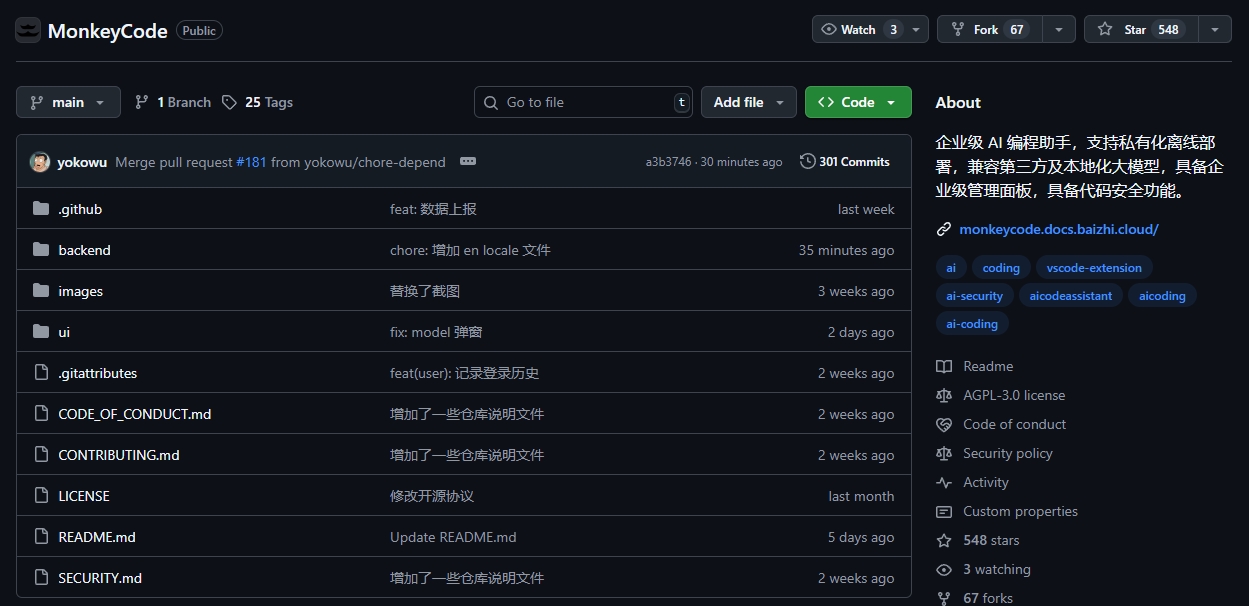

本着“发现问题,寻找解决方案”的职业病,我最近在 GitHub 上“闲逛”时,发现了一款刚刚开源的企业级 AI 编程平台——MonkeyCode。有意思的是,我一眼就认出它和苏米之前分享的开源 AI 知识库出自同门,有兴趣可以看看:

PandaWiki:手把手教你用这款开源神器,3分钟搭建你的专属AI知识库!

MonkeyCode 是什么?

简单来说,MonkeyCode 是一个支持完全私有化部署、专为企业研发团队设计的 AI 编程辅助平台。

如果说 GitHub Copilot 和 Cursor 是给个人开发者的“超级外挂”,那么 MonkeyCode 的定位更像是给企业研发团队配备的“AI 赋能与安全管控中心”。它的核心价值主张(Value Proposition)非常清晰,直击当前企业使用 AI 编码的三大痛点:

-

数据泄露风险:害怕核心源代码在与云端大模型交互时被泄露或用于训练。

-

管理失控风险:团队成员不受控地使用各种 AI 工具,行为无法审计,效果无法评估。

-

安全质量风险:AI 生成的代码可能存在安全漏洞或质量问题,引入新的技术债。

MonkeyCode 瞄准的,正是这个“既要、又要、还要”的复杂企业场景。你可以把它理解为一个自带安全基因和管理后台的“企业安全版 Cursor”。

核心价值

在我看来,MonkeyCode 的产品设计思路非常“To B”(面向企业),它不是在功能上堆砌,而是在解决关键的、高价值的企业问题。

1. 数据安全与隐私

这是 MonkeyCode 最具杀伤力的特性。它支持一键式私有化部署,可以将整个平台(包括后端服务和管理面板)都部署在企业内网服务器中。

-

产品体验:这意味着代码数据 100% 留存在本地,永远不会离开你的防火墙。对于金融、军工、政务、高新科技研发等对数据安全要求极为严苛的行业,这几乎是使用 AI 编程的唯一可行方案。

-

扩展思考:它还支持在完全离线的环境下运行,只要你部署了本地大模型(如通义千问的 Qwen-Coder、CodeLlama 等)。这种极致的私有化能力,为特殊场景下的研发团队提供了可能。

2. 管理与洞察

如果说私有化解决了“安全”问题,那么企业级管理面板则解决了“治理”问题。这正是我认为它远超 Cursor Team 版的地方。

功能亮点:

-

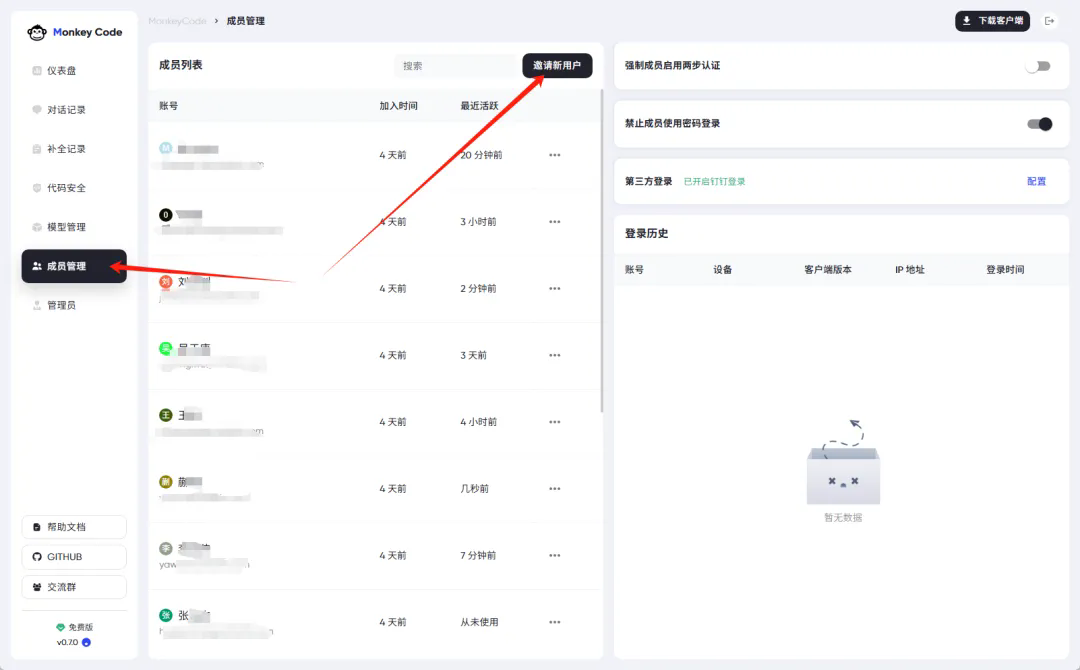

行为审计:管理员可以清晰地看到团队成员何时、对哪个项目、使用了 AI 进行了哪些代码生成或修改操作。这对于合规审计和问题追溯至关重要。

-

权限管控:可以精细化地管理团队成员对不同 AI 模型、不同功能的访问权限。

-

效率统计:通过可视化的仪表盘,管理者可以直观地看到 AI 对团队开发效率的提升情况,例如代码采纳率、生成代码行数等。这不再是凭感觉,而是用数据来衡量 AI 的 ROI(投资回报率)。

-

产品经理点评:这个管理面板的设计,体现了深刻的 To B 思维。它把 AI 从一个“个人工具”转变为一个“受管控的企业资源”,解决了管理者的核心关切。

3. 内建安全基因:

背靠长亭科技强大的安全背景,MonkeyCode 内置了代码安全扫描引擎。

-

产品体验:当 AI 生成代码时,系统能自动扫描其中是否存在已知的安全漏洞(如 SQL 注入、跨站脚本等)。如果发现高风险代码,会进行拦截或告警。

-

价值所在:这相当于在开发流程的最前端增加了一个“AI 安全卫士”,帮助开发者避免“不小心”引入由 AI 带来的安全问题,降低了代码审计的压力。

4. 开放的模型兼容性

作为一个平台,开放性至关重要。MonkeyCode 支持接入多种大模型,赋予了企业极大的灵活性。

支持的模型(根据官方信息及搜索补齐):

-

云端 API:支持接入 OpenAI (GPT-4/3.5)、月之暗面 (Kimi)、深度求索 (DeepSeek Coder)、智谱 (GLM)、阿里通义千问等主流商业模型 API。

-

本地模型:支持私有化部署的开源模型,如 Qwen-Coder、DeepSeek-Coder、CodeLlama 等,兼容 Ollama 等本地模型运行框架。

-

产品经理点评:这种混合模式非常聪明。企业可以根据不同需求和成本预算,灵活切换模型。比如,核心业务代码使用内网本地模型确保安全,非核心任务则可以调用性价比高的云端 API。

价格策略

根据其 GitHub 开源地址和企业级功能的定位,我推断 MonkeyCode 采用了经典的 开源 + 商业版 模式:

开源社区版:核心的 VS Code 插件和基础的私有化部署能力是开源免费的,适合个人开发者或小型团队进行体验和基础使用。

企业版 (Enterprise Edition):更高级的功能,如企业级管理面板、代码安全扫描、SAML/LDAP 单点登录、专业技术支持等,应该是需要付费订阅的商业版本。

具体价格:官方并未公布标准定价。这在 To B 领域非常常见,通常需要联系销售团队,根据企业规模、部署方式(公有云/私有云/本地)、所需功能和支持级别来提供定制化报价。

部署与使用

服务器部署依旧丝滑,整个过程按官方的文档走就可以了:

第一步:服务端一键部署 (管理员)

使用官方提供的一行 bash 命令,在 Linux 服务器上以 root 用户身份执行,整个安装过程确实只需要几分钟,对运维相当友好。

bash -c "$(curl -fsSLk https://release.baizhi.cloud/monkeycode/manager.sh)"

根据命令行提示完成安装(耗时约几分钟)。安装完成后,终端会输出以下信息:

SUCCESS 控制台信息: SUCCESS 访问地址(内网): http://...:80 SUCCESS 用户名: admin SUCCESS 密码: ******

浏览器打开访问地址,你将看到 MonkeyCode 控制面板的登录入口。 使用用户名 admin 和记录的初始密码登录。

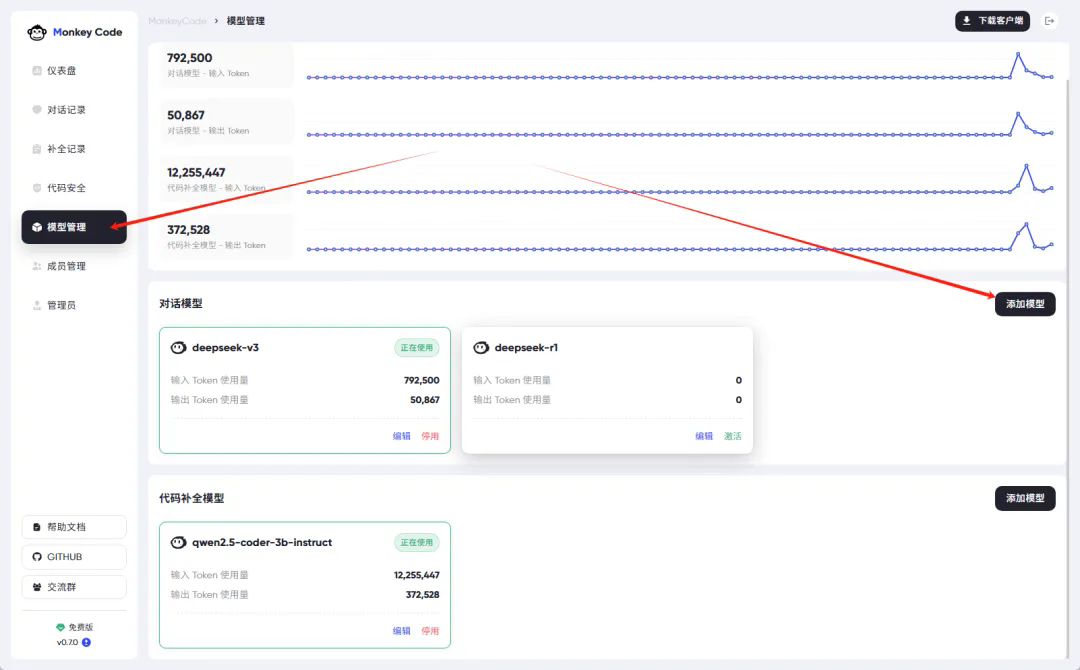

第二步:配置大模型 (管理员)

登录管理后台后,在“模型管理”中可以轻松接入大模型,目前国产大模型 deekseep-v3、kimi-k2、qwen2.3-coder 都支持。

填入 API Key 或本地地址即可。

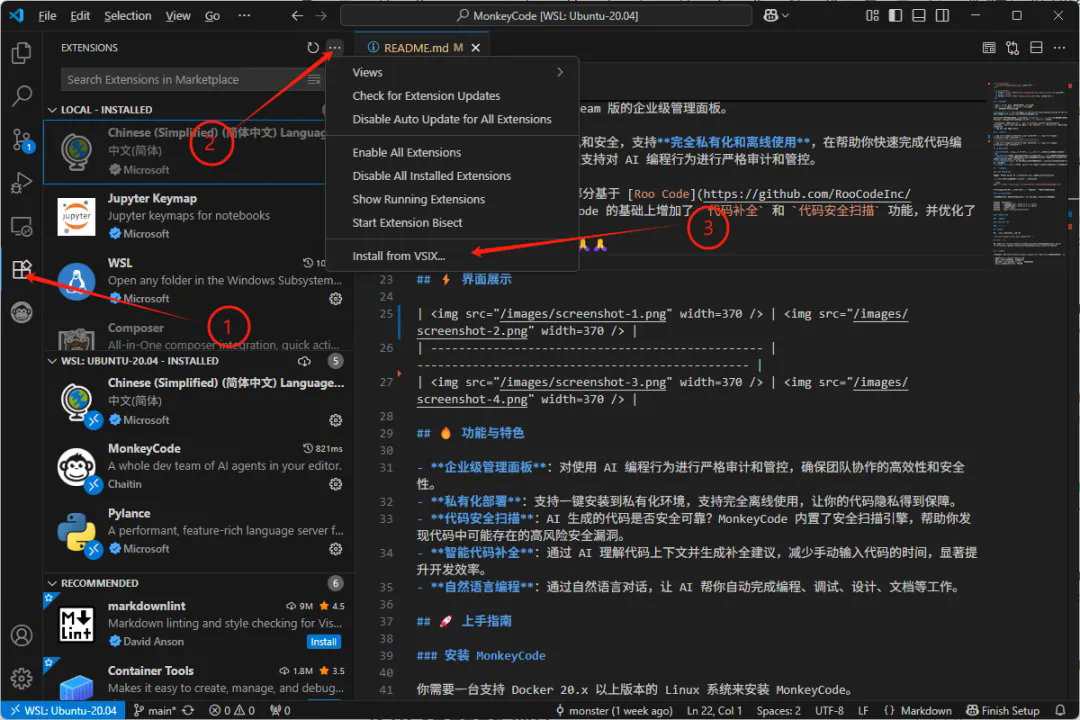

第三步:邀请团队成员 & 插件安装 (用户)

管理员在后台生成邀请链接,成员点击链接即可注册账号,并下载 VS Code 插件(.vsix 文件)。

在 VS Code 中通过 "Install from VSIX..." 方式安装插件

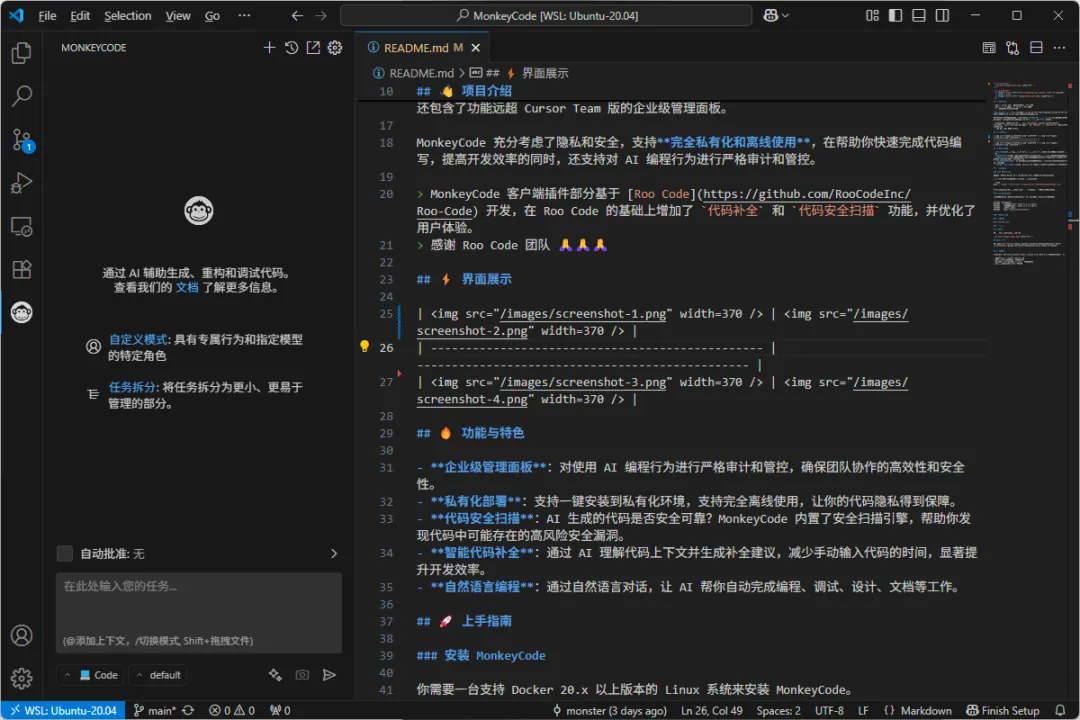

插件装好后点击登录,会自动跳转到浏览器完成认证,然后就可以在 IDE 中愉快地使用了。

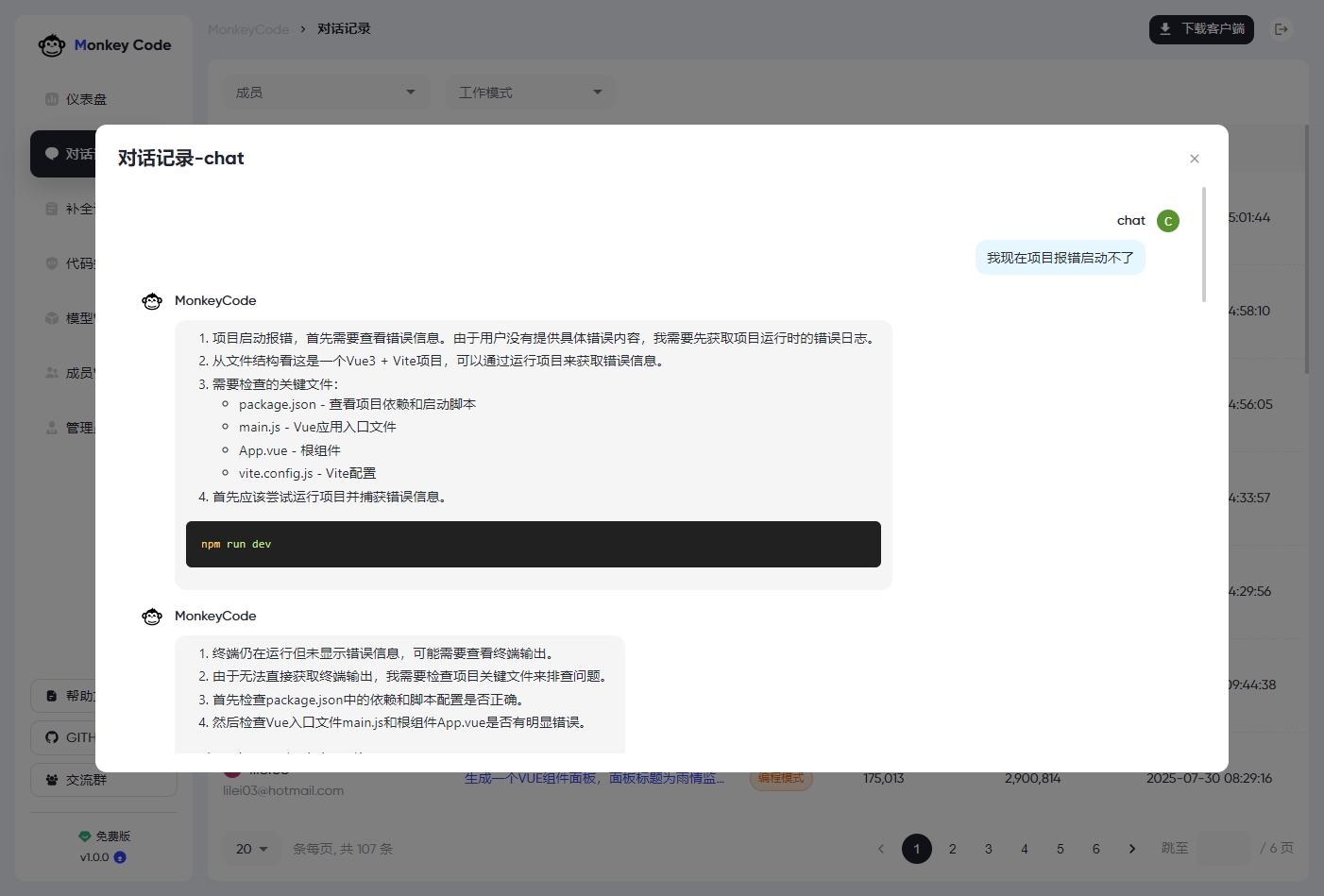

插件的核心体验和主流工具类似:

-

对话式编码:直接在聊天框里提需求,AI 生成代码。

-

上下文感知:可以用

@符号引用当前文件或目录,让 AI 理解得更准。 -

代码补全 (Inline Completion):在你写代码时,AI 会给出灰色建议,按

Tab即可采纳。 -

代码 Diff 视图:AI 修改代码后,会清晰地展示修改前后的对比,方便确认和采纳。

整个 onboarding(上手)流程设计得比较流畅,降低了企业内部的推广和使用门槛。

总结

MonkeyCode 不是要和 Copilot 或 Cursor 在个人开发者市场一较高下,它的战场在企业,它的核心武器是“安全与合规”。

它精准地抓住了企业从“尝鲜” AI 编程,到“规模化、规范化”应用 AI 编程这个转型阶段的刚需。对于那些手握核心代码资产,又渴望拥抱 AI 提升研发效能的企业来说,MonkeyCode 提供了一个高可信度的解决方案。

AI 编程的下半场,将是企业级市场的竞争,而“安全”和“可控”将是这场竞争的胜负手。

项目地址:https://github.com/chaitin/MonkeyCode

官方文档:https://monkeycode.docs.baizhi.cloud/

官方演示:http://115.29.210.236/ (账号密码:admin / EqcufzWwQq0R8z3QMtIWbP1q9t7Uetn5)